Snabblänkar

- Vad är Apple Intelligence?

- Siri blir smart

- Apple Intelligence talar ditt språk

- Generera bilder som anpassade emoji

- Vida åtgärder i appar < /li>

- Personligt sammanhang är allt

- Sekretess är inbyggd

- Integrerad ChatGPT

- Apple Intelligence-kompatibilitet

Nyckelalternativ

h3>

- Hösten 2024 ger Apple Intelligence till iPhone, iPad och Mac-modeller med en A17 Pro eller M1-processor och senare.

- Förvänta dig smartare Siri-interaktioner, textgenereringsverktyg, bildgenereringsmöjligheter och möjligheten att styra olika systemomfattande åtgärder med naturliga språkkommandon.

- Apple prioriterar integritet med bearbetning på enheten och planer för framtida chipdesigner för att förbättra AI.

Om du har en iPhone 15 Pro eller en iPad eller Mac med en M1-processor eller bättre, kan Apple Intelligence förändra hur du interagerar med din smartphone, surfplatta och dator. Här är vad du kan förvänta dig inför lanseringen hösten 2024.

Vad är Apple Intelligence?

Apple Intelligence är Apples version av artificiell intelligens för stora språkmodeller (LLM). Det är ungefär som befintliga verktyg som ChatGPT och Google Gemini, förutom att det bara fungerar inom Apples ekosystem. Många av Apples befintliga verktyg och appar kommer att få stöd för Apple Intelligence när funktionen lanseras.

Apple

Apple Dessa nya AI-funktioner kommer att komma under hösten med lanseringen av iOS 18, iPadOS 18 och macOS 15 Sequoia.

Siri blir smart

Vid hjärtat av Apple Intelligence är en förbättrad version av Siri, företagets digitala assistent. Apple lovar att Apple Intelligence kommer att göra Siri mer personlig, mer naturlig och bättre på att visa relevant information. Siri är gränssnittet genom vilket användare i första hand kommer att interagera med AI-modellen.

Den nya och förbättrade Siri kan bättre förstå talade förfrågningar, inklusive de där du snubblar över dina ord. Sammanhang upprätthålls mellan förfrågningar, så du kan göra saker som att utfärda ett uppföljningskommando som följer tråden i din konversation. Du kan fråga efter vädret på en plats och sedan följa upp med en platsspecifik påminnelse för samma plats utan att nämna platsnamnet igen.

Apple

Apple strong>

Du kommer att kunna utfärda mer komplexa kommandon och Siri borde kunna förstå dem. Du kan be Siri att hitta dina bilder tagna med en specifik person på en viss plats, sedan redigera bilden och sedan skicka den till en kontakt. Kontexten bibehålls så att Siri stannar på samma sida, varje steg på vägen.

En ny funktion som heter typ-till-Siri låter dig utfärda kommandon till Siri utan att använda din röst. Detta betyder inte bara att du kan utfärda “tyst” kommandon var som helst genom att helt enkelt skriva, men det förvandlar effektivt Siri till ett ChatGPT-liknande promptgränssnitt.

Siri kommer också att kunna förstå vad som händer på din skärm när som helst. Detta gör att du kan utfärda kommandon relaterade till vilken information som helst på skärmen. Ett exempel är att lägga till en adress till ett kontaktkort medan du chattar i ett meddelandefönster.

strong>

På iPhone får Siri också ett helt nytt utseende. Istället för den vanliga Siri-bubblan som visas längst ner på sidan, kommer aktivering av Siri nu att placera en glödande kant runt skärmens kant. Siri-implementeringen på Mac ser i stort sett oförändrad ut, med konversationer som äger rum i det övre högra hörnet av skärmen.

Apple betonade att Siri-förbättringar kommer att pågå under nästa uppdateringscykels livslängd, så förvänta dig att assistenten blir mer intelligent med nya uppdateringar till iOS 18, iPadOS 18 och macOS 15 Sonoma.

Apple Intelligence talar ditt språk

Apple Intelligence låter dig generera och analysera text på sätt som borde vara användbara i hela systemet, oavsett om du använder en telefon, surfplatta eller dator. Apple har introducerat en uppsättning skrivverktyg som låter dig markera och sedan skriva om delar av texten, anpassa efter tonen. Du kan skapa nya versioner eller återgå till den ursprungliga texten när som helst.

Kontextmedvetna svar låter dig generera svar baserat på innehållet i ett meddelande eller e-post. Dessa visas i rutan Snabbtyp på en iPhone och ger uppmaningar om att samla information. Du kan trycka på några rutor och Apple Intelligence kommer att svara in natura.

Förutom att skriva om och svara, visar ett nytt korrekturverktyg grammatik och stavfel. Du kan gå igenom varje förslag ett efter ett, eller acceptera allt med ett tryck eller ett klick.

Apple

Apple Apple Intelligence kan analysera texter och fatta beslut baserat på sammanhanget. Detta tillämpas på saker som din e-postinkorg med smart prioritering. , där du ser dina viktigaste meddelanden högst upp i inkorgen. Du får också sammanfattningar överst i långa e-postkedjor, så att du snabbt kan komma ikapp trådar som du har missat.

Du kommer också att få möjligheten att transkribera text från röstmemon (tagna direkt i Notes, en ny iOS 18-funktion) och via telefonappen på din iPhone.

Slutligen kommer Apple Intelligence att sortera dina meddelanden baserat på vikt. En ny “Reducera avbrott” toggle kommer bara att visa de viktigaste aviseringarna, som en smartare version av tidskänsliga meddelanden som introducerades i iOS 15.

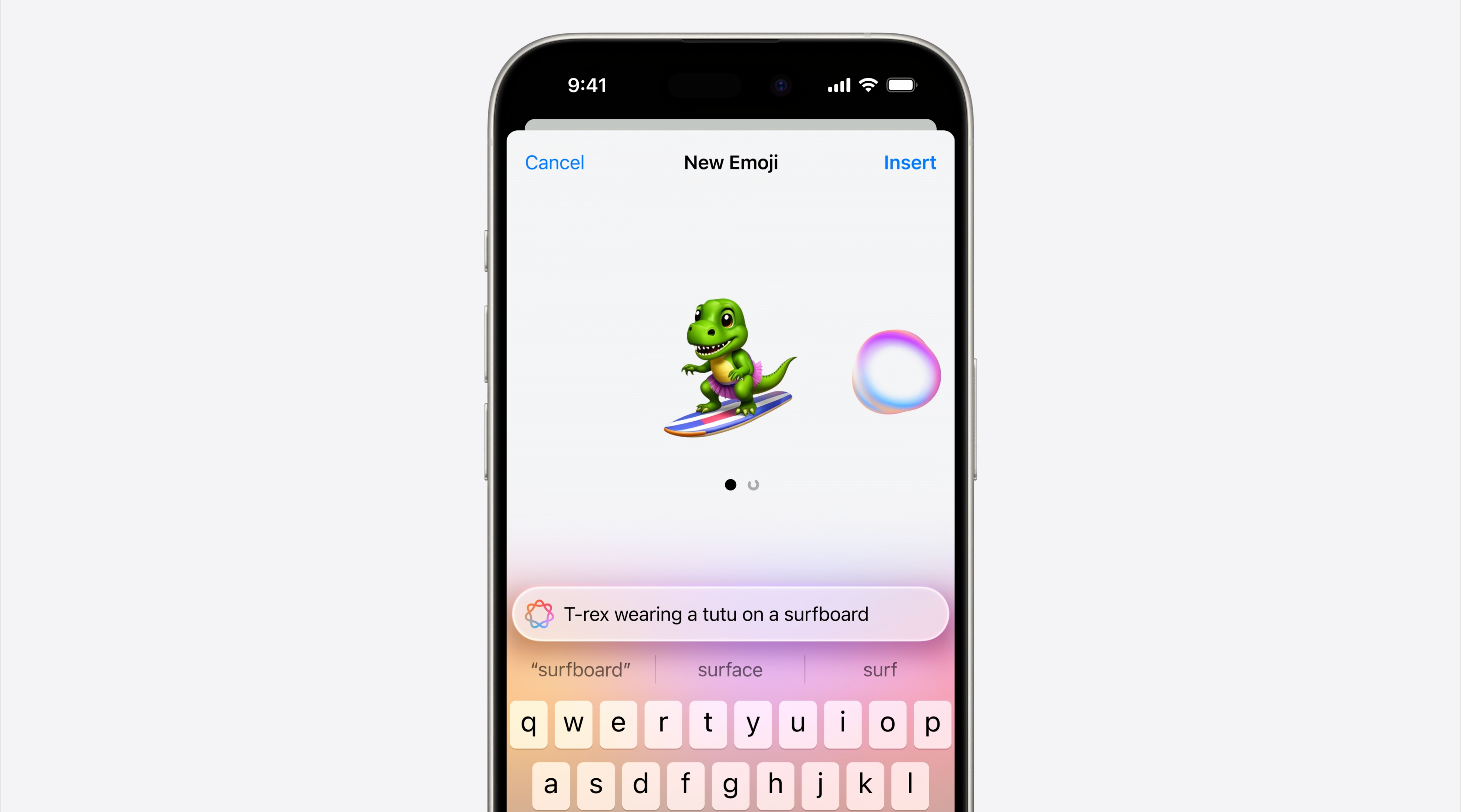

Generera bilder som anpassad emoji

Apples modell inkluderar också generativa bildfunktioner, som börjar med Genmoji. Förkortning för “generative emoji,” Apple Intelligence kommer att skapa nya emoji baserade på dina uppmaningar, med flera alternativ för dig att sortera igenom. Du kan sedan skicka dem som tapbacks, klistermärken eller som in-line emoji i dina meddelanden. Apple visade också upp en funktion som genererar emoji baserat på kontaktens utseende.

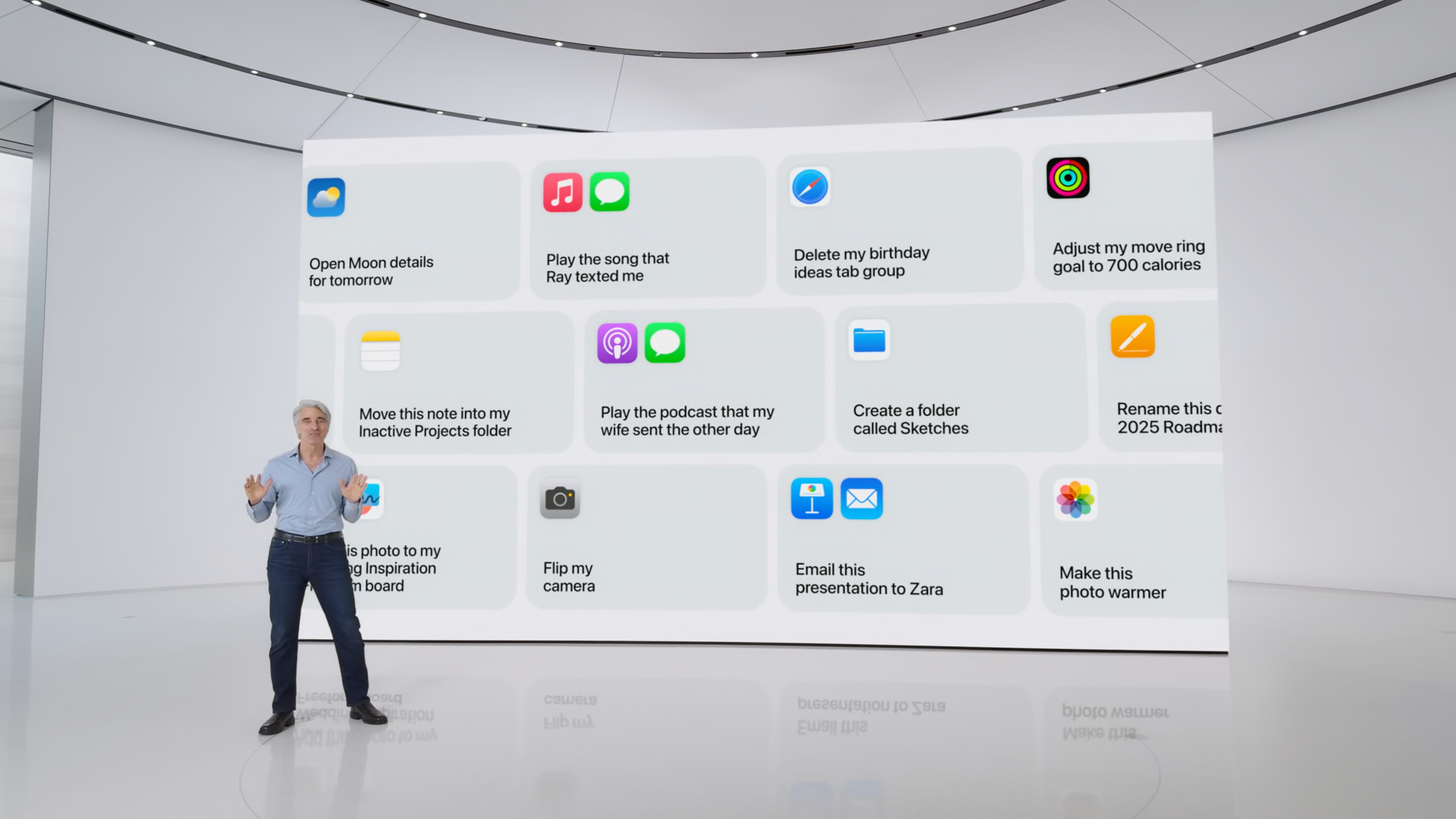

Image Playground är Apples version av ett generativt AI-bildverktyg, som DALL-E och Midjourney. Det här verktyget kommer att vara tillgängligt som en fristående app; kommer att integreras i appar som Messages, Freeform och Pages; och kan läggas till appar från tredje part med Apples API. Det fungerar genom att tagga teman, föremål och tillbehör i ett visuellt gränssnitt och generera bilder baserat på vad du har valt. Du kan skriva manuella uppmaningar eller lägga till objekt från en lista med förslag och välja stilar som skiss, illustration och animation. Bildgenerering sker på din enhet. En förlängning av Image Playground som heter Image Wand lägger till sammanhangsmedveten generering till andra appar. Genom att välja Image Wand från listan över verktyg som visas i Notes-appen kan du generera bilder baserat på sammanhanget för din anteckning eller omvandla grova skisser till färdiga AI-genererade konstverk. Apple Intelligence ger också snabbredigering till Foton. Du kan inte bara skälla instruktioner på appen för att utföra standardredigeringar som att göra en bild varmare, utan du kan också använda ett bildrensningsverktyg för att ta bort oönskade föremål från bilder. Apple gör det också enklare att skapa minnesfilmer från ditt fotobibliotek. Istället för att leta efter en lista med relevanta bilder manuellt kan du skicka en uppmaning och Photos kommer att välja bilder och generera en film åt dig. Det borde inte komma som någon överraskning att bilderna i Apples WWDC-presentation hade det generativa AI-utseendet” till dem. Detta är par för kursen när det gäller AI-genererade bilder. Där Apple Intelligence börjar avvika från verktyg som ChatGPT är dess förmåga att utföra åtgärder. Detta är en unik position som bara plattformsinnehavare kan inta, och Apple verkar inte slösa bort tid på att ta fram snabba åtgärder till iOS, iPadOS och macOS. Apple gav massor av exempel under sin WWDC-avslöjande, från enkla kommandon som “skapa en mapp som heter New” och “vänd min kamera” till mer avancerade kontextspecifika kommandon som “spela upp podden som min fru skickade häromdagen.” Några av de andra exemplen som blinkade förbi i bakgrunden var att ta bort specifika fliksessioner, hitta och sedan tillämpa redigeringar på foton, lägga till objekt i anteckningar och spela musik. Vi får vänta och se hur det här går, men baserat på Apples exempel är vi glada över att se vad som är möjligt. Mångfalden av kommandon var tillräckligt varierande för att göra oss entusiastiska över potentialen. Det slutliga målet här bör vara att bygga upp tillräckligt med förtroende för användaren så att de inte tvekar att försöka utföra vardagliga uppgifter med Apple Intelligence. Om Apple kan klara av det kan det här vara något speciellt. Den verkliga skillnaden mellan Apples implementering och något som ChatGPT är att din iPhone (eller iPad eller Mac) är kärnan i upplevelsen. Din enhet förstår redan mycket om dig: personerna du pratar med, när du åker till jobbet, platserna du besöker och så vidare. Genom att utnyttja detta sammanhang blir dessa AI-drivna operationer personliga. De blir mycket mer användbara och mycket mer relevanta. Om din iPhone förstår vem din chef är, när du pratar med honom och vilken typ av ton som är lämplig är svaren du genererar i ett e-postmeddelande mycket mer användbara. Sökning är ett område där detta sammanhang verkligen kan komma väl till pass. Med Apple Intelligence kan du be Siri att hitta en länk från någon du fick förra veckan, oavsett om du kommer ihåg om det var ett mejl eller ett meddelande. Du kan visa information från konversationer som du har glömt att anteckna, som en adress eller vilken tid du ska träffas. Siri kan använda all information på din enhet som assistenten redan känner till. Några exempel inkluderar innehållet i din inkorg, filerna du nyligen har sparat, ämnen i meddelandetrådar, påminnelser du har glömt bort, länkar du har delat, kommande kalenderhändelser, pass som du har lagt till i Wallet-appen och så vidare. Den andra stora affären med Apples implementering är företagets fokus på integritet. Apple har positionerat sig som ett företag som gör allt för att respektera användarnas integritet, och Apple Intelligence för denna ficklampa vidare. Många av dessa förfrågningar kommer att ske helt på enheten. För uppgifter som kräver mer processorkraft, ökar Apples Private Cloud Compute. Din enhet påstås endast skicka relevant data till Apples servrar när det behövs. Denna data lagras aldrig och är förmodligen aldrig tillgänglig för Apple. Dessa servrar byggdes av Apple med sina egna Apple Silicon-chips speciellt för Apple Intelligence. Det återstår att se hur många av dessa förfrågningar som kan utföras på- enhet. När enheterna blir kraftfullare är det troligt att majoriteten av dessa operationer kommer att slutföras offline i framtiden. Apple är all-in på AI vid det här laget, så förvänta dig att framtida chipdesigner prioriterar Apple Intelligence-kapacitet. Siri kommer också att ha ett fönster till ChatGPT 4o, som kommer “senare i år” enligt WWDC-meddelandet. Apple hävdar att förfrågningar till ChatGPT inte kommer att loggas, och du kommer till och med att kunna ansluta ditt OpenAI-konto för att få tillgång till premiumfunktioner om du är prenumerant. När Siri upptäcker att ChatGPT kanske kan hjälpa till kommer den att erbjuda att skicka din förfrågan eller bild till tjänsten. När du har gett ditt tillstånd kommer begäran att behandlas och du får ett svar. Du kan till och med använda GPT 4o i Apples skrivverktyg för att generera text och använda DALL-E för att skapa bilder. ChatGPT-integration kommer att vara gratis för alla Apple Intelligence-användare. Tyvärr kräver Apple Intelligence en modern Apple-enhet som iPhone 15 Pro (A17) eller en iPad eller Mac med en M1 processor. Både iPhone 16 och iPhone 16 Pro förväntas vara kompatibla med tjänsten tack vare det kommande A18-chippet. Medan Apple Intelligence kan ha varit det största tillkännagivandet av WWDC 2024, Apple skickade också chockvågor runt om i världen med tillkännagivandet av en iPadOS Calculator-app.  Apple

Apple

Apple

Apple

Vidta åtgärder över appar

Apple

Apple Personlig kontext är allt

Apple

Apple Sekretess är inbyggd

Apple

Apple Integrerad ChatGPT

Apple Intelligence-kompatibilitet

Leave a Reply

You must be logged in to post a comment.