Link rapidi

- Cos'è Apple Intelligence?

- Siri diventa intelligente

- Apple Intelligence parla la tua lingua

- Genera immagini come emoji personalizzate

- Esegui azioni su tutte le app

- Il contesto personale è tutto

- La privacy è integrata

- ChatGPT integrato

- Compatibilità con Apple Intelligence

Concetti chiave

- L’autunno 2024 porterà Apple Intelligence sui modelli di iPhone, iPad e Mac con processore A17 Pro o M1 e versioni successive.

- Aspettatevi interazioni Siri più intelligenti, strumenti di generazione di testo, funzionalità di generazione di immagini e la capacità di controllare varie azioni a livello di sistema con comandi in linguaggio naturale.

- Apple dà priorità alla privacy nell'elaborazione sul dispositivo e prevede progetti futuri di chip per migliorare l'intelligenza artificiale.

Se hai un iPhone 15 Pro o un iPad o un Mac con un processore M1 o superiore, Apple Intelligence potrebbe trasformare il modo in cui interagisci con il tuo smartphone, tablet e computer. Ecco cosa aspettarti prima del lancio nell'autunno 2024.

Cos'è Apple Intelligence?

Apple Intelligence è la versione Apple dell'intelligenza artificiale LLM (Large Language Model). È molto simile agli strumenti esistenti come ChatGPT e Google Gemini, tranne per il fatto che funziona esclusivamente all'interno dell'ecosistema Apple. Molti degli strumenti e delle app esistenti di Apple riceveranno il supporto per Apple Intelligence quando verrà lanciata la funzionalità.

Apple

Apple Questi nuovi Le funzionalità AI arriveranno in autunno con il rilascio di iOS 18, iPadOS 18 e macOS 15 Sequoia.

Siri diventa intelligente

A il cuore di Apple Intelligence è una versione migliorata di Siri, l'assistente digitale dell'azienda. Apple promette che Apple Intelligence renderà Siri più personale, più naturale e più efficace nel far emergere informazioni rilevanti. Siri è l'interfaccia attraverso la quale gli utenti interagiranno principalmente con il modello AI.

La nuova e migliorata Siri può comprendere meglio le richieste vocali, comprese quelle in cui inciampi nelle parole. Il contesto viene mantenuto tra le richieste, così puoi fare cose come impartire un comando di follow-up che segue il filo della tua conversazione. Potresti chiedere il meteo in una località, quindi seguire con un promemoria specifico per la stessa località senza menzionare di nuovo il nome del luogo.

Apple

Apple

Potrai impartire comandi più complessi e Siri dovrebbe essere in grado di capirli. Potresti chiedere a Siri di trovare le foto scattate con una persona specifica in un determinato luogo, quindi modificare la foto e inviarla a un contatto. Il contesto viene mantenuto in modo che Siri rimanga sulla stessa pagina, in ogni fase del percorso.

Una nuova funzionalità chiamata type-to-Siri ti consente di impartire comandi a Siri senza usare la voce. Ciò significa non solo che puoi emettere messaggi “silenziosi” comandi ovunque semplicemente digitando, ma trasforma effettivamente Siri in un'interfaccia prompt simile a ChatGPT.

Siri sarà anche in grado di capire cosa sta succedendo sul tuo schermo in ogni momento. Ciò ti consentirà di impartire comandi relativi a qualsiasi informazione sia presente sullo schermo. Un esempio è l'aggiunta di un indirizzo a una scheda di contatto durante la chat in una finestra Messaggi.

Su iPhone, anche Siri ha un look completamente nuovo. Invece della solita bolla di Siri che appare nella parte inferiore della pagina, l'attivazione di Siri ora posizionerà un bordo luminoso attorno al bordo dello schermo. L’implementazione di Siri su Mac sembra sostanzialmente invariata, con le conversazioni che si svolgono nell’angolo in alto a destra dello schermo.

Apple ha sottolineato che i miglioramenti di Siri continueranno per tutta la durata del prossimo ciclo di aggiornamento, quindi aspettati che l'assistente diventi più intelligente con i nuovi aggiornamenti a iOS 18, iPadOS 18 e macOS 15 Sonoma.

Apple Intelligence parla la tua lingua

Apple Intelligence ti consente di generare e analizzare il testo in modi che dovrebbero essere utili in tutto il sistema, sia che tu sia su un telefono, un tablet o un computer. Apple ha introdotto una serie di strumenti di scrittura che consentono di evidenziare e quindi riscrivere sezioni di testo, adattandone il tono. Puoi generare nuove versioni o ripristinare il testo originale in qualsiasi momento.

Le risposte sensibili al contesto ti consentono di generare risposte in base al contenuto di un messaggio o di un'e-mail. Questi vengono visualizzati nella casella Quick Type su un iPhone e forniscono istruzioni per raccogliere informazioni. Puoi toccare alcune caselle e Apple Intelligence risponderà a tono.

Oltre a riscrivere e rispondere, un nuovo strumento di correzione di bozze mostra errori di grammatica e ortografia. Puoi spostarti attraverso ogni suggerimento uno per uno o accettare tutto con un tocco o un clic.

Apple

Apple Apple Intelligence può analizzare corpi di testo e prendere decisioni in base al contesto. Questo si applica a cose come la tua casella di posta elettronica con priorità intelligente. , dove vedrai i tuoi messaggi più importanti nella parte superiore della posta in arrivo. Riceverai anche riepiloghi in cima a lunghe catene di posta elettronica, permettendoti di recuperare rapidamente i thread che ti sei perso.

Avrai anche la possibilità di trascrivere il testo dai memo vocali (presi direttamente in Note, una nuova funzionalità di iOS 18) e tramite l'app Telefono sul tuo iPhone.

Infine, Apple Intelligence ordinerà le tue notifiche in base all'importanza. Una nuova sezione “Riduci le interruzioni” L'interruttore mostrerà solo le notifiche più importanti, come una versione più intelligente delle notifiche Time Sensitive introdotte in iOS 15.

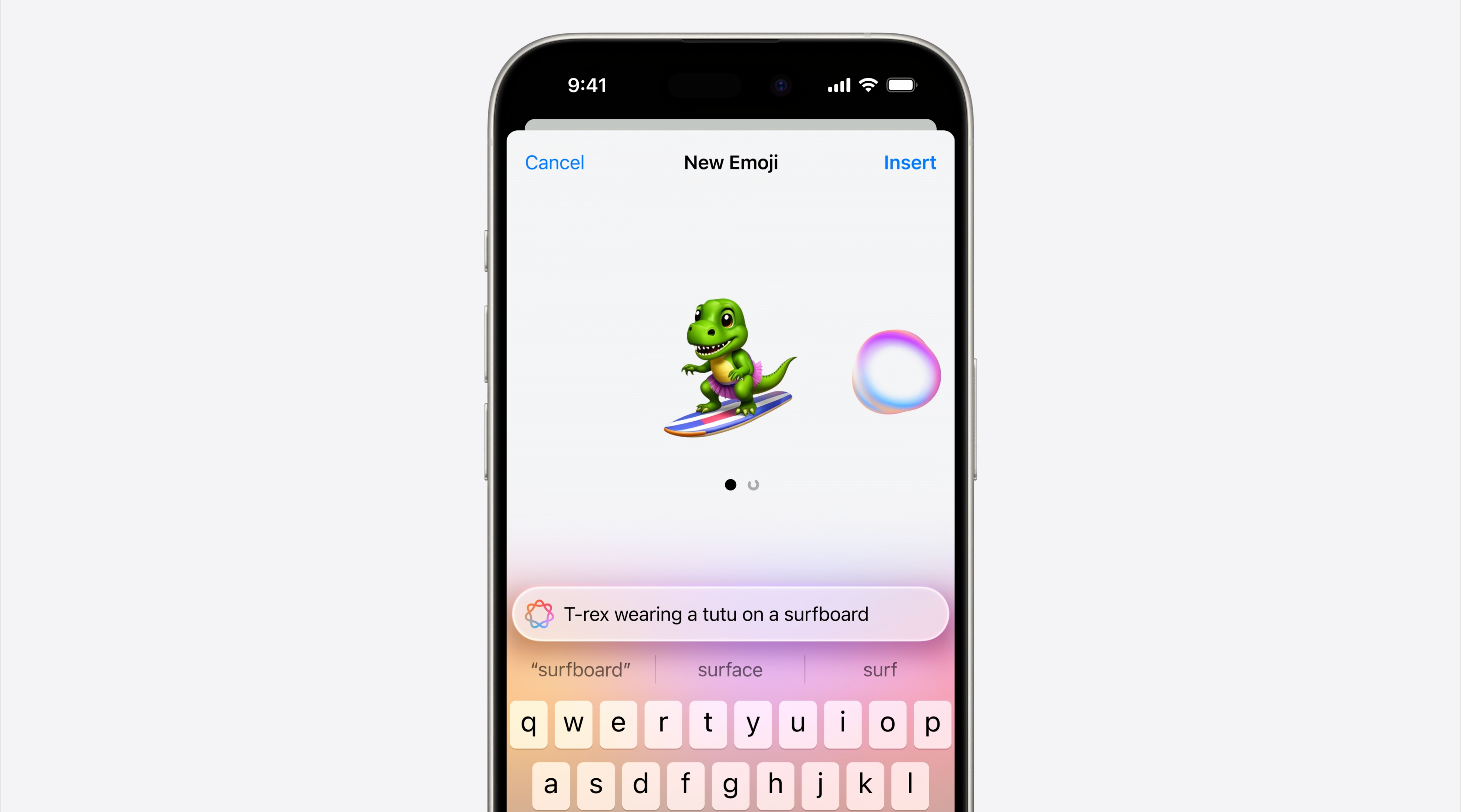

Genera immagini come emoji personalizzate

Il modello di Apple include anche funzionalità di immagine generativa, a partire da Genmoji. Abbreviazione di “emoji generativa”, rdquo; Apple Intelligence creerà nuove emoji in base alle tue istruzioni, con più opzioni da ordinare. Puoi quindi inviarli come tapback, adesivi o come emoji in linea nei tuoi messaggi. Apple ha anche mostrato una funzionalità che genera emoji in base all'aspetto del contatto.

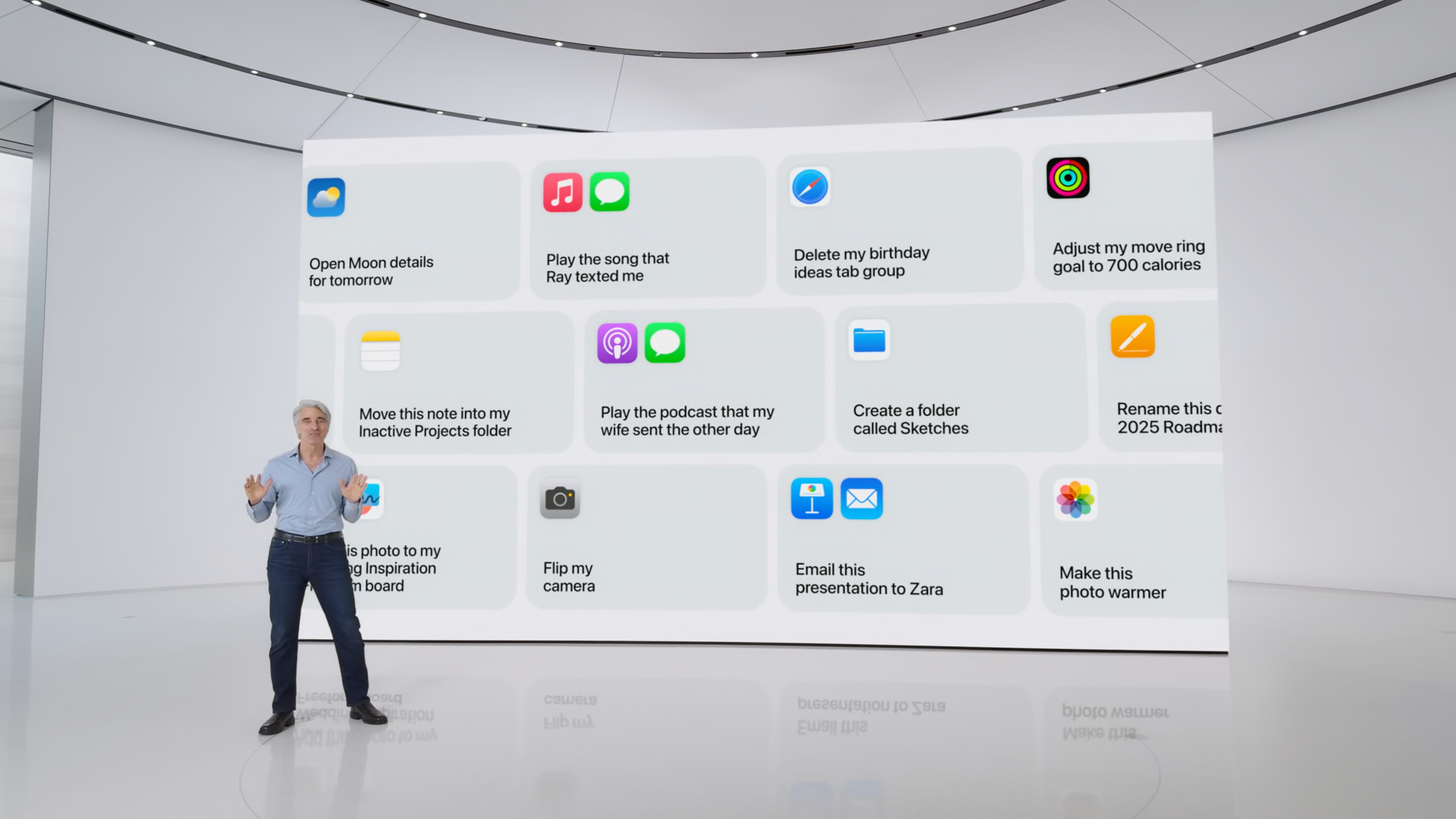

Image Playground è la versione di Apple di uno strumento di immagine AI generativo, come DALL-E e Midjourney. Questo strumento sarà disponibile come app autonoma; sarà integrato in app come Messaggi, Freeform e Pages; e può essere aggiunto ad app di terze parti utilizzando l'API di Apple. Funziona taggando temi, articoli e accessori in un'interfaccia visiva e generando immagini in base a ciò che hai selezionato. Puoi digitare richieste manuali o aggiungere articoli da un elenco di suggerimenti e selezionare stili come schizzo, illustrazione e animazione. La generazione delle immagini avviene sul tuo dispositivo. Un'estensione di Image Playground chiamata Image Wand aggiunge la generazione sensibile al contesto ad altre app. Selezionando la bacchetta immagine dall'elenco di strumenti visualizzato nell'app Notes, puoi generare immagini in base al contesto della tua nota o trasformare schizzi grezzi in opere d'arte finite generate dall'intelligenza artificiale. Apple Intelligence introduce anche in Foto la modifica basata su prompt. Non solo puoi abbaiare istruzioni sull'app per eseguire modifiche standard come scaldare un'immagine, ma puoi anche utilizzare uno strumento di pulizia delle immagini per rimuovere elementi indesiderati dalle immagini. Apple sta inoltre semplificando crea filmati ricordo dalla libreria di Foto. Invece di cercare manualmente un elenco di immagini pertinenti, puoi inviare un messaggio e Foto selezionerà le immagini e genererà un filmato per te. Non dovrebbe sorprendere che le immagini presenti nella presentazione di Apple al WWDC avessero quell'aspetto generativo dell'intelligenza artificiale. a loro. Questo è normale quando si tratta di immagini generate dall’intelligenza artificiale. Il punto in cui Apple Intelligence inizia a deviare da strumenti come ChatGPT è nella sua capacità di eseguire azioni. Questa è una posizione unica che solo i titolari della piattaforma possono assumere e Apple sembra non perdere tempo nel portare azioni basate su prompt su iOS, iPadOS e macOS. Apple ha fornito numerosi esempi durante la presentazione alla WWDC, da semplici comandi come “crea una cartella chiamata Nuova” e “capovolgi la fotocamera” a comandi più avanzati specifici del contesto come “riproduci il podcast che mia moglie ha inviato l'altro giorno”. Alcuni degli altri esempi che sono apparsi in background includevano l'eliminazione di sessioni di schede specifiche, la ricerca e l'applicazione di modifiche alle foto, l'aggiunta di elementi alle note e la riproduzione di musica. Dovremo aspettare e vedere come andrà a finire, ma sulla base degli esempi di Apple siamo entusiasti di vedere cosa è possibile. La varietà di comandi era sufficientemente varia da entusiasmarci per il potenziale. L'obiettivo finale dovrebbe essere quello di creare abbastanza fiducia nell'utente da spingerlo a non esitare a provare a eseguire attività quotidiane con Apple Intelligence. Se Apple riuscisse a farcela, potrebbe trattarsi di qualcosa di speciale. La vera differenza tra l'implementazione di Apple e qualcosa come ChatGPT è che il tuo iPhone (o iPad o Mac) è al centro dell'esperienza. Il tuo dispositivo capisce già molto di te: con le persone con cui parli, quando esci per andare al lavoro, i luoghi che frequenti e così via. Sfruttando questo contesto, queste operazioni basate sull'intelligenza artificiale diventano personali. Diventano molto più utili e molto più rilevanti. Se il tuo iPhone capisce chi è il tuo capo, quando gli parli e che tipo di tono è appropriato, le risposte che generi in un'e-mail sono molto più utili. La ricerca è un'area in cui questo contesto può davvero tornare utile. Con Apple Intelligence puoi chiedere a Siri di trovare un collegamento da qualcuno che hai ricevuto la settimana scorsa, indipendentemente dal fatto che ricordi se si trattava di un'e-mail o di un messaggio. Puoi far emergere informazioni da conversazioni di cui hai dimenticato di prendere nota, come un indirizzo o l'ora in cui dovresti incontrarti. Siri può utilizzare tutte le informazioni del tuo dispositivo che l'assistente già conosce. Alcuni esempi includono il contenuto della tua casella di posta, i file che hai salvato di recente, gli argomenti nei thread dei messaggi, i promemoria che hai dimenticato, i link che hai condiviso, i prossimi eventi del calendario, i pass che hai aggiunto all'app Wallet e Presto. L'altro grosso problema con l'implementazione di Apple è l'attenzione dell'azienda alla privacy. Apple si è posizionata come un’azienda che fa di tutto per rispettare la privacy degli utenti e Apple Intelligence porta avanti questa fiaccola. Molte di queste richieste avverranno interamente sul dispositivo. Per le attività che richiedono maggiore potenza di elaborazione, il Private Cloud Compute di Apple fa un passo avanti. Presumibilmente il tuo dispositivo invierà dati rilevanti ai server Apple solo quando necessario. Questi dati non vengono mai archiviati e presumibilmente non sono mai accessibili ad Apple. Questi server sono stati costruiti da Apple utilizzando i propri chip Apple Silicon appositamente per Apple Intelligence. Resta da vedere quante di queste richieste possono essere eseguite sul dispositivo. Man mano che i dispositivi diventano più potenti, è probabile che in futuro la maggior parte di queste operazioni verrà completata offline. Apple punta tutto sull'intelligenza artificiale a questo punto, quindi aspettati che i futuri progetti di chip diano priorità alle capacità di Apple Intelligence. Siri avrà anche una finestra per ChatGPT 4o, in arrivo “entro la fine dell'anno” secondo l'annuncio del WWDC. Apple afferma che le richieste a ChatGPT non verranno registrate e sarai anche in grado di connettere il tuo account OpenAI per accedere alle funzionalità premium se sei un abbonato. Quando Siri rileva che ChatGPT potrebbe essere in grado di aiutarti, si offrirà di inviare la tua richiesta o immagine al servizio. Una volta data la tua autorizzazione, la richiesta verrà elaborata e riceverai una risposta. Puoi anche utilizzare GPT 4o negli strumenti di scrittura di Apple per generare testo e utilizzare DALL-E per generare immagini. L'integrazione di ChatGPT sarà gratuita per tutti gli utenti di Apple Intelligence. Sfortunatamente, Apple Intelligence richiede un moderno dispositivo Apple come l'iPhone 15 Pro (A17) o un iPad o Mac con un Processore M1. Si prevede che sia l'iPhone 16 che l'iPhone 16 Pro saranno compatibili con il servizio grazie al prossimo chip A18. Mentre Apple Intelligence potrebbe essere stato il più grande annuncio della WWDC 2024, Apple ha anche inviato onde d'urto in tutto il mondo con l'annuncio di un'app Calcolatrice per iPadOS.  Apple

Apple

Apple

Apple

Esegui azioni tra le app

Apple

Apple Il contesto personale è tutto

Apple

Apple La privacy è integrata

Apple

Apple ChatGPT integrato

Compatibilità con Apple Intelligence

Leave a Reply

You must be logged in to post a comment.