Snabblänkar

- Annonser som främjar bedrägeri med skadlig programvara

- AI-genererad social profilbedrägeri

- Imitation-bedrägeri

- Sälja AI-relaterade produkter bluff

- Hur du räddar dig själv från detta

- Var säker på sociala medier i AI:s tidsålder

AI:s framväxt har potential att förändra många aspekter av våra liv. Men denna kraftfulla teknik innebär också nya utmaningar, särskilt när det gäller bedrägerier i sociala medier. Om du inte har skarpa ögon, skarpa öron och lite kritiskt tänkande kan det sluta med att du blir offer.

Om du undrar vilken typ av bedrägerier jag pratar om, läs sedan vidare. Jag kommer att dela med mig av några av de vanligaste AI-relaterade bedrägerierna jag själv har sett och hört från andra som har upplevt dem.

Annonser som främjar bedrägeri med skadlig programvara

När du bläddrar genom Facebook och andra sociala medieplattformar kommer du sannolikt att märka annonser om AI-verktyg. Även om vissa av dessa annonser är autentiska och handlar om verkliga verktyg, är många av dessa annonser bedrägerier som försöker främja trojaner och virus för att infektera din enhet. Vissa av dessa bluffannonser riktar sig direkt mot välkända AI-verktyg som ChatGPT, Gemini och Microsoft Copilot för att framstå som mer trovärdiga.

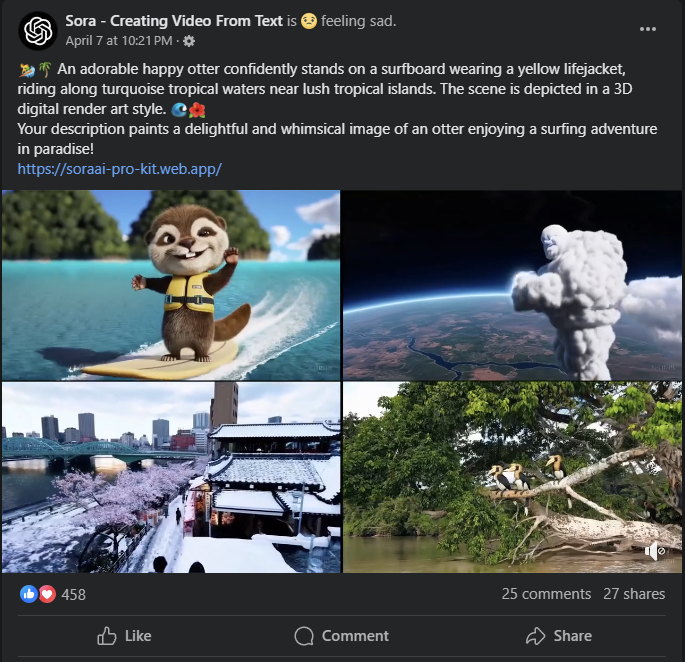

Ta till exempel annonsen nedan om Sora AI-modellen från OpenAI.

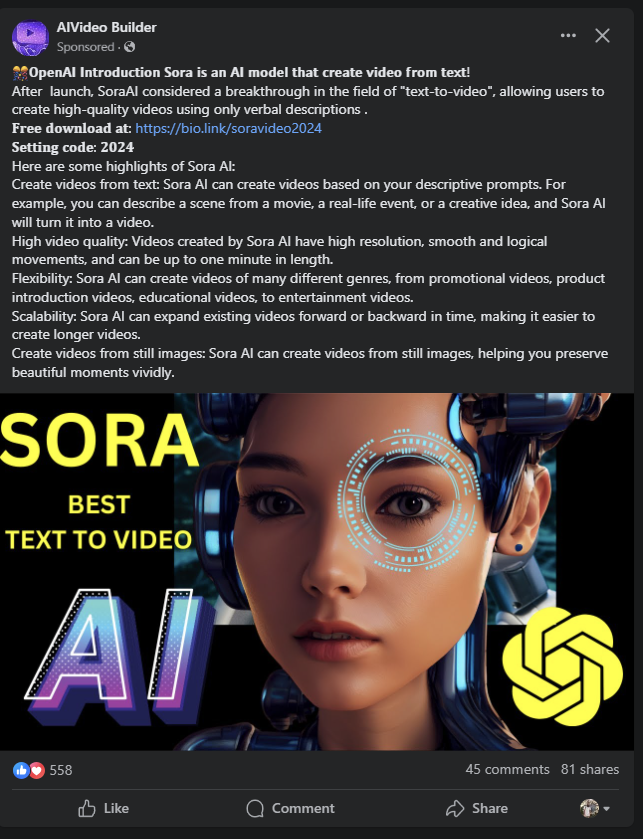

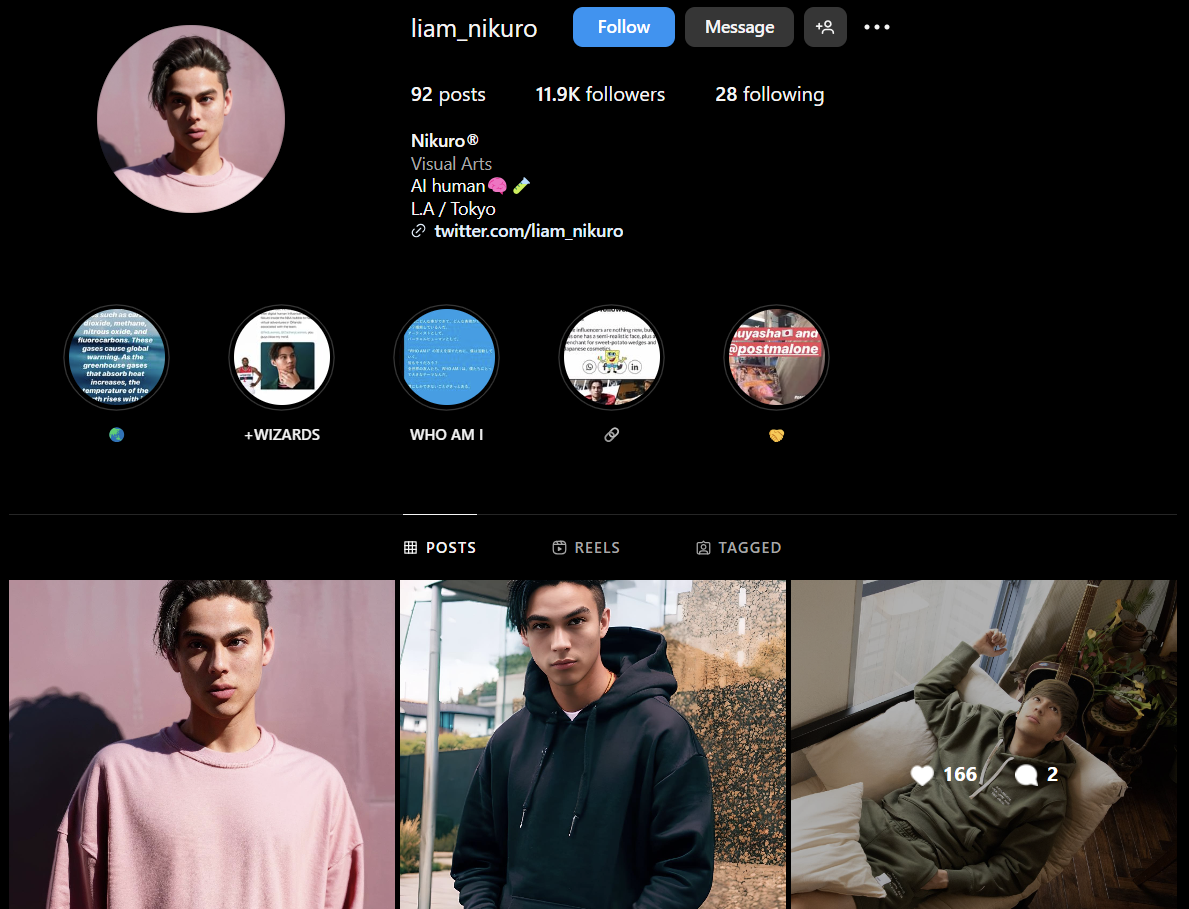

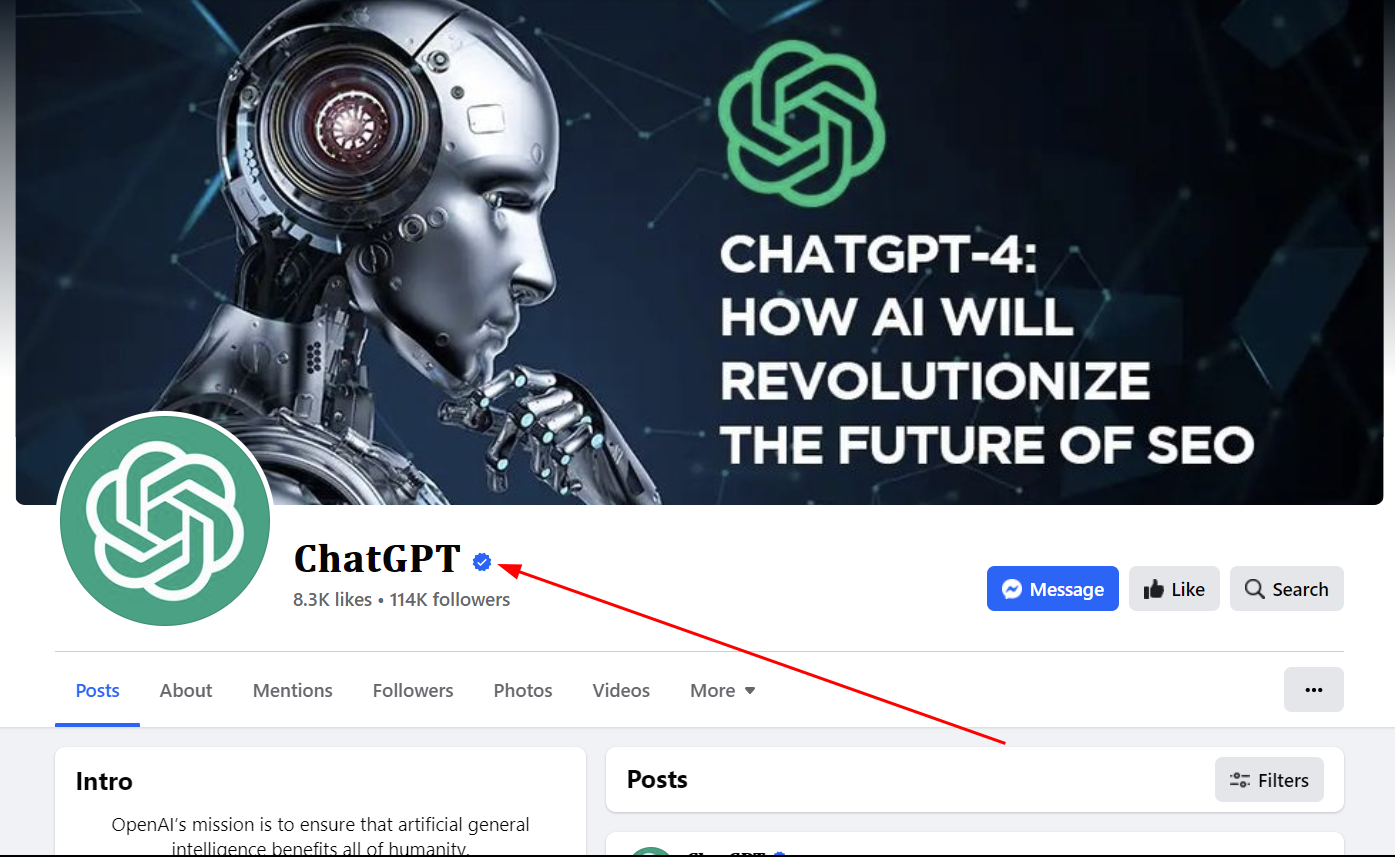

Sora har inte släppts till offentlig ännu när detta skrevs. Men precis som den här annonsen, närhelst ett företag tillkännager ett nytt AI-verktyg och det får en viss dragkraft, agerar vissa sociala sidor som om de marknadsför dessa verktyg när de i verkligheten försöker lura dig. Ibland hittar du sidor som inte utger sig som företaget självt utan tredje part som marknadsför AI-verktygen. Tekniken är ganska lik. Här är en jag hittade häromdagen. En annan vanlig fallet är när något av dessa AI-verktyg får en större uppdatering. Så dessa falska sidor skapar annonser relaterade till uppdateringen och ber dig ladda ner den senaste versionen av verktyget. Här är ett exempel på just det. Vad som är mer oroande är att vissa människor faller faktiskt för dessa bedrägerier. Engagemanget i sådana annonser pekar på det. När du har laddat ner den medföljande "programvaran" packa upp det och installera det, du installerar skadlig programvara på din enhet. Chansen är stor att bedragaren kan få tillgång till hela ditt system, inklusive inloggningsuppgifter för sociala medier och annan känslig information. Medan bedragare försöker utnyttja din data med AI-relaterade annonser, innebär ett annat framväxande hot att skapa helt falska sociala medieprofiler. Det fanns en tid när folk brukade skapa bots för att följa och engagera sig. Men du kan lätt identifiera dem. Med AI-bildgenereringsmöjligheter kan vem som helst skapa realistiska bilder av människor i en skala. Vi har nu AI-influencers, virtuella människor som inte existerar, med tusentals följare. Även om det här kanske inte ser så illa ut vid första anblicken, kan illvilliga människor använda den här idén för att lura andra. Föreställ dig ett tilläggsföretag som använder dessa AI-influenser för att marknadsföra sina farliga produkter. Människor kommer att falla i den här influencerfällan och köpa dem. Vissa företag kan gå längre än och generera före-efter-bilder för att visa att deras produkt fungerar. Massproduktion av falska vittnesmål är en annan rimlig användning av AI-sociala profiler. Dessa AI-genererade profiler kan också konstrueras för att delta i till synes genuina konversationer och bygga relationer med naiva människor. Detta är särskilt farligt i samband med romantiska bedrägerier, där bedragare utnyttjar känslomässiga sårbarheter för att extrahera pengar eller personlig information. Den här typen av bedrägeri tar AI-genererade sociala profiler till nästa nivå. Bedragare slutar inte bara med att skapa slumpmässiga profiler utan riktar sig mot verkliga människor och skapar profiler som matchar deras utseende och personlighet. De gör det genom att mata in riktiga data om den personen till AI-modeller. Kändisar och internetpersonligheter är de största offren för detta. Bedragare använder AI för att utveckla anmärkningsvärt övertygande imitationer av riktiga människor. De kan använda deepfakes och AI-genererade foton av populära personligheter, influencers eller till och med dina vänner och familj. Dessa personifieringar används sedan för att vinna ditt förtroende och utnyttja dig ekonomiskt och känslomässigt. Vissa AI-tekniker kan klona mänskliga röster, vilket gör det mer katastrofalt. Detta är inte nödvändigtvis en bluff som är specifik för AI-verktyg. Men eftersom AI är ett trendigt ämne, kan bedragare dra nytta av människors intressen ännu mer. En typ av bedrägeri är att annonsera någon form av banbrytande AI-programvara. Först när du köper och använder det inser du att det är en falsk bootleg-version av de befintliga verktygen och erbjuder minimala funktioner jämfört med vad som annonserades. Vissa andra bedragare erbjuder dig prenumerationer på AI-verktyg till ett billigare pris. Vad de egentligen gör är att köpa ett abonnemang och dela det kontot med flera personer. Om någon annan eller säljaren själv ändrar användaruppgifterna för kontot kommer du inte att kunna använda det kontot längre. Ännu värre, ibland, efter att ha fått dina pengar, kommer de att blockera dig omedelbart. Om något på sociala medier ser för bra ut för att vara sant så är det förmodligen det. Se den här annonsen nedan som marknadsför en ChatGPT Plus-prenumeration för endast $8 per år. Sedan har vi såklart så kallade AI-guruer som inte säljer verktyg till dig utan snarare produkter relaterade till dem. Några av de vanliga produkterna de erbjuder inkluderar "beprövade" AI-uppmaningar, verktygsguider, kurser och allt om att tjäna pengar med AI. I verkligheten har produkterna bara information på ytan och inget speciellt värt att betala för. Lustigt nog tjänar de pengar med AI genom att lära folk hur man tjänar pengar med AI. Det betyder inte att det är något fel med att sälja AI-relaterade produkter eller att det inte finns några riktiga AI-experter. Men så många människor positionerar sig som AI-experter med ompaketerad information så att de kan tjäna en förmögenhet på andras bekostnad. När fler bedrägerier ökar på sociala medier måste du vara mer uppmärksam i alla dina onlineinteraktioner. Detta inkluderar vem du ansluter till, vem du köper från och vilken information du konsumerar. AI-verktyg förbättras snabbt, men lyckligtvis är det möjligt att upptäcka AI-genererade nyheter, foton och till och med videor. Du kan ta hjälp av verktyg, men att träna dig själv i att veta vad som är verkligt och vad som inte är kan vara fördelaktigt för de kommande dagarna. Var försiktig med annonser som kommer från inofficiella källor. Du kan identifiera dem genom dålig grammatik, misstänkta länkar och orealistiska löften. Vanligtvis är företagens officiella sidor verifierade (kolla efter den blå bocken på Facebook och X) och har en bra engagemangshistorik. Var extra försiktig när du köper online. Köp endast från pålitliga säljare med gott rykte. Om du hittar något billigare än det officiella priset måste det finnas något skumt. Försök att göra din egen forskning. Det handlar om att söka efter recensioner, kolla företagets webbplats och använda faktakontrollmyndigheter. Ta inte allt du ser på sociala medier för nominellt värde. Om du hittar misstänkta sociala profiler, annonser, meddelanden eller andra aktiviteter, rapportera dem till den sociala plattformen. Detta hjälper sociala medieföretag att identifiera och ta bort bedrägerier snabbare. Som AI-verktyg fortsätt förbättra, vi borde vara mer försiktiga i onlinevärlden. Det kommer att finnas dörrar till nya möjligheter eftersom det kommer att finnas nya utmaningar att övervinna. Genom att följa tipsen ovan kan du minska risken att falla offer och säkerställa en positiv upplevelse av sociala medier.

AI-genererad social profilbedrägeri

Impersonation-scam

meyer_solutions/Shutterstock.com < /figur>

meyer_solutions/Shutterstock.com < /figur> Att sälja AI-relaterade produkter bluff

Hur du räddar dig från detta

Håll dig säker på sociala medier i AI-tiden

Leave a Reply

You must be logged in to post a comment.