Wichtige Erkenntnisse

- Large Language Models (LLMs) unterstützen KI-Chatbots wie ChatGPT und Google Bard und ermöglichen es ihnen, Anfragen zu verarbeiten und Antworten bereitzustellen.

- LLMs stützen sich auf das Vortraining großer Datenmengen und einer Reihe von Parametern, um zu bestimmen, wie sie Text produzieren und auf Eingabeaufforderungen reagieren.

- LLMs wie KI-Chatbots haben vielfältige Einsatzmöglichkeiten, darunter die Bereitstellung von Fakten, die Übersetzung von Texten, die Generierung von Ideen und die Verbesserung von Suchmaschinenergebnissen.

Obwohl KI-Chatbots wie ChatGPT mittlerweile unglaublich beliebt sind, verstehen viele von uns immer noch nicht, wie sie funktionieren. Diese Chatbots basieren auf LLMs und diese Technologie birgt großes Potenzial für die Zukunft. Was ist also ein LLM und wie ermöglicht es der KI, Gespräche mit Menschen zu führen?

Was ist ein LLM?

Der Begriff "LLM" ist die Abkürzung für Large Language Model. Ein großes Sprachmodell bietet den Rahmen für KI-Chatbots wie ChatGPT und Google Bard und ermöglicht es ihnen, Anfragen zu verarbeiten und Antworten bereitzustellen.

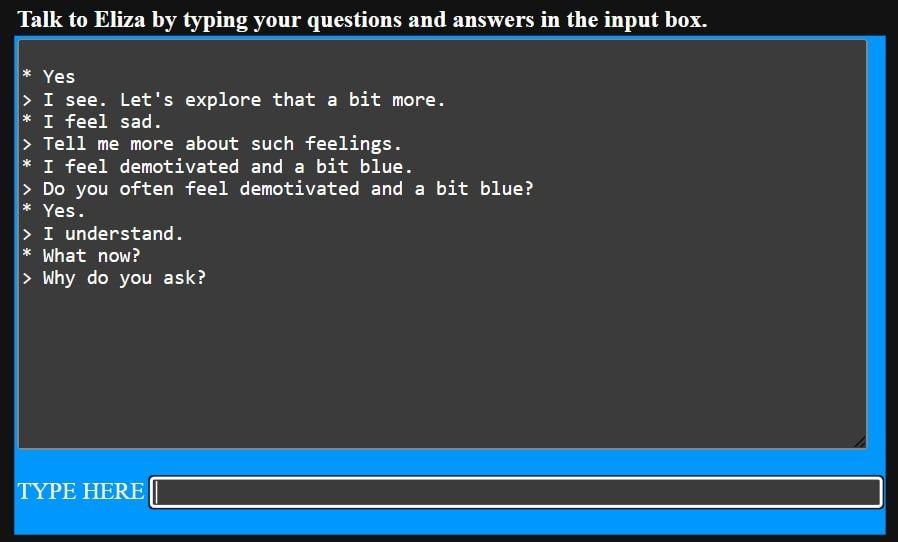

Das Konzept der Konversationscomputer gab es schon lange bevor das erste Beispiel dieser Technologie in die Praxis umgesetzt wurde. Bereits in den 1930er Jahren entstand die Idee eines Konversationscomputers, blieb jedoch völlig theoretisch. Jahrzehnte später, im Jahr 1967, wurde der weltweit erste Chatbot, ELIZA, entwickelt. ELIZA wurde von Joseph Weizenbaum vom MIT entwickelt und war ein textbasiertes Programm, das eine als „Pattern Matching“ bekannte Taktik nutzte. um mit Benutzern zu sprechen, und nutzte einen Bestand an Konversationsskripten, aus denen Antworten abgerufen werden konnten.

Das New Jersey Institute of Technology bietet auch heute noch eine webbasierte Version von ELIZA an, mit der man interagieren kann.

New Jersey Institute of Technology/Joseph Weizenbaum

New Jersey Institute of Technology/Joseph Weizenbaum Wie Sie sehen, ist ELIZA nicht besonders gut darin, Sprache zu interpretieren und nützliche Informationen bereitzustellen. Als Erfindung der 1960er-Jahre war dieser Chatbot jedoch bahnbrechend, da er relativ menschlich auf Aufforderungen reagieren und gleichzeitig ein Gespräch fortsetzen konnte. Oben haben wir ELIZA gesagt, dass wir traurig sind, und sie konnte uns bitten, mehr darüber zu erzählen und zu fragen, wie lange wir uns schon so gefühlt haben.

Während ELIZA eine innovative Erfindung war, handelte es sich nicht um ein LLM. Tatsächlich dauerte es weitere 47 Jahre, bis eine Technologie erreicht wurde, die den heutigen LLMs nahe kommt.

Im Jahr 2013 wurde ein Algorithmus namens word2vec zum jüngsten Vorfahren des LLM. Word2vec ist ein Algorithmus zur Verarbeitung natürlicher Sprache (NLP), der ein Wort nimmt und es in eine Reihe von Zahlen umwandelt, die als Vektor bezeichnet werden. Das mag oberflächlich betrachtet einfach erscheinen, aber das Erstaunliche an word2vec ist, dass es nach der Vektorisierung semantische Verbindungen zwischen verschiedenen Wörtern herstellen konnte. Diese Fähigkeit, Assoziationen zwischen Wörtern herzustellen, war ein großer Schritt in Richtung moderner LLMs.

Obwohl viele OpenAI und seinen Chatbot ChatGPT damit in Verbindung bringen, LLMs hervorgebracht zu haben, ist dies nicht der Fall. Der erste LLM-Durchbruch gelang Google 2017 mit seinen Bidirektionalen Encoder-Repräsentationen von Transformers (BERT). BERT wurde entwickelt, um den Suchmaschinenalgorithmus von Google zu verbessern, sodass Benutzersuchen besser interpretiert werden können und somit bessere Suchergebnisse bereitgestellt werden.

Vor der Veröffentlichung von BERT haben mehrere Google-Forscher einen Artikel mit dem Titel Attention Is verfasst und veröffentlicht Alles was du brauchst. Dieses Papier bereitete den Weg für Transformatoren, indem es diese Technologie der Welt vorstellte. Wir werden uns später etwas genauer mit der Funktionsweise von Transformatoren befassen.

Im Jahr 2022 erreichen LLMs den Mainstream, als KI-Chatbots wie ChatGPT, Claude und Google Bard in aller Munde sind. Die Veröffentlichung von OpenAIs ChatGPT-3.5 war der Auslöser für diesen neuen Trend, da der Chatbot ein sehr beeindruckendes Konversations-KI-Tool bot, das menschliche Sprache sehr effektiv verarbeiten konnte. Seitdem sind LLMs zu einem heißen Gesprächsthema geworden und jede Woche werden weitere LLM-basierte Tools veröffentlicht.

Was steckt also hinter dieser beeindruckenden Technologie?

Wie funktionieren LLMs?

Ein entscheidendes Element, das viele beliebte LLMs benötigen, ist die Vorschulung. Bevor eine LLM-Verarbeitungssprache zum Einsatz kommt, muss sie anhand einer großen Datenmenge sowie einer Reihe von Parametern trainiert werden.

Nehmen Sie zum Beispiel GPT-3.5 von OpenAI. Dieser LLM wurde für alle Arten textbasierter Daten geschult, darunter Bücher, Artikel, wissenschaftliche Zeitschriften, Webseiten, Online-Beiträge und mehr. Darüber hinaus werden Milliarden von Variablen, sogenannte „Parameter“, eingerichtet, um zu bestimmen, wie GPT-3.5 Text erzeugt und auf Eingabeaufforderungen reagiert. Das Training von GPT-3.5 umfasste auch zwei weitere Aspekte, die als „Verstärkung“ bekannt sind. und „Vorhersage des nächsten Wortes“.

Andere Arten von LLMs durchlaufen jedoch einen anderen Vorprozess, wie z. B. multimodale und Feinabstimmung. DALL-E von OpenAI wird beispielsweise zum Generieren von Bildern auf der Grundlage von Eingabeaufforderungen verwendet und verwendet einen multimodalen Ansatz, um eine textbasierte Antwort entgegenzunehmen und im Gegenzug ein pixelbasiertes Bild bereitzustellen (d. h. eine Form von Eingabemedien). wird in ein anderes Ausgabemedium konvertiert).

Googles BERT hingegen durchläuft einen vorläufigen Prozess, der als Feinabstimmung bezeichnet wird und sich weniger auf die Erstellung natürlichsprachlicher Antworten konzentriert, sondern mehr auf die Reaktion auf spezifischere Aufgaben wie Textklassifizierung und Beantwortung von Fragen (was die Qualität der Suchergebnisse verbessert).

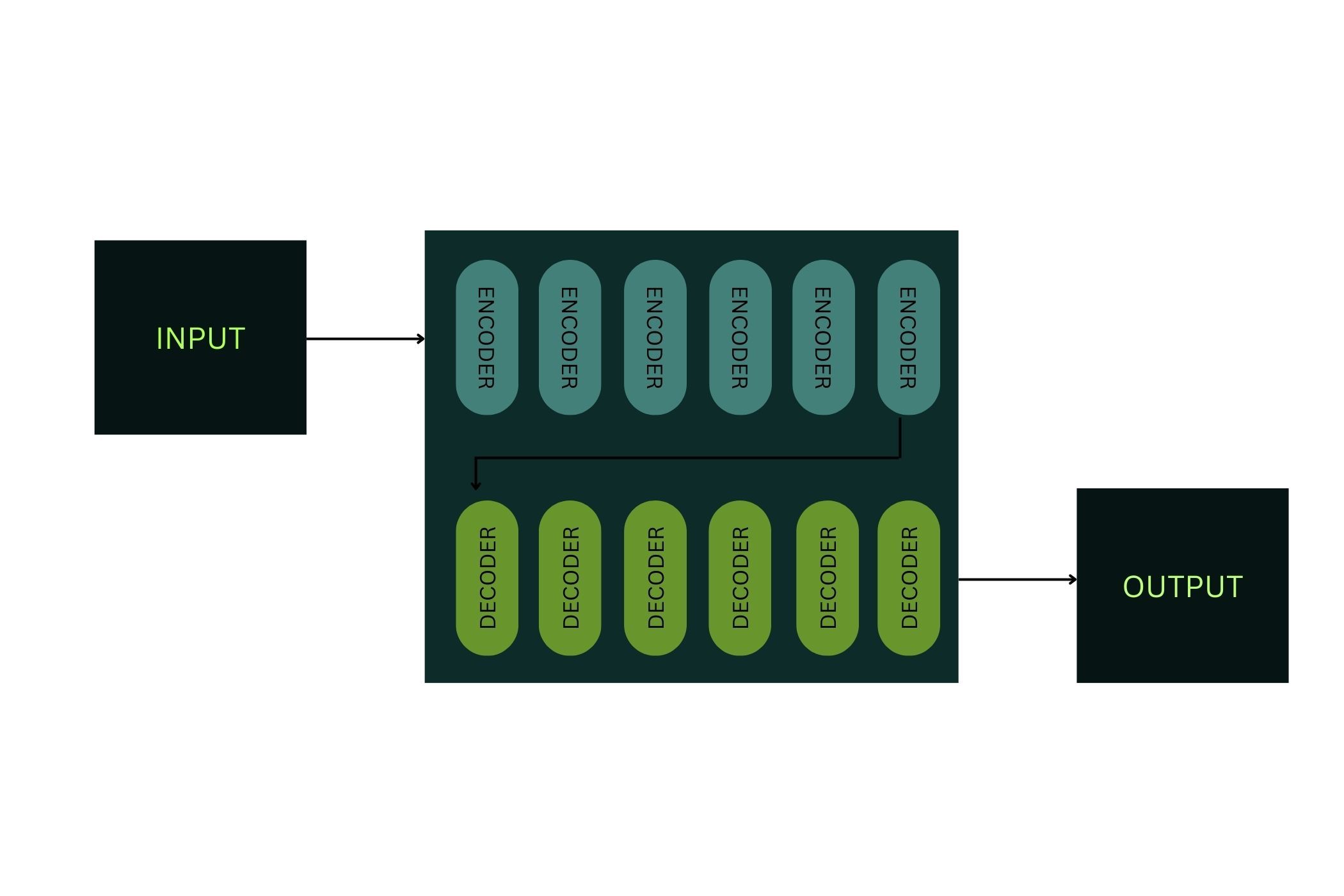

LLMs basieren ebenfalls auf einem neuronalen Netzwerk, um zu funktionieren, und der am häufigsten verwendete Typ ist als a bekannt Transformator. Nachfolgend finden Sie ein grundlegendes Diagramm, das den Prozess eines Transformators darstellt. Wir gehen jedoch detaillierter darauf ein, um die Funktionsweise besser zu verstehen.

Katie Rees

Katie Rees Transformer-Neuronale Netze spielen eine entscheidende Rolle dabei, dass das System vorhersagen kann, welche Wörter als nächstes kommen und welche Bedeutung und welchen Kontext jedes Wort in einem bestimmten Satz hat. Innerhalb des Transformatormodells gibt es einen Encoderschritt und einen Decoderschritt, die jeweils aus mehreren Schichten bestehen. Zunächst erreichen textbasierte Daten den Encoder und werden dann in Zahlen umgewandelt.

Diese einzelnen numerischen Einheiten werden auch als Token bezeichnet, weshalb Sie möglicherweise den Begriff „Token-Limit“ hören. wenn über KI-Chatbots gesprochen wird.

Diese Token werden dann vom Transformator kategorisiert, wodurch eine Karte der Bedeutung jedes Tokens und der Beziehung zwischen einem Token und einem anderen erstellt wird. Kurz gesagt: Der Transformator verwendet die von ihm erstellte numerische Karte, um den Kontext rund um die Daten und die Verbindung eines Tokens mit einem anderen zu verstehen. Dieser Vorgang wird auch als transformierende Selbstaufmerksamkeit oder Mehrkopfaufmerksamkeit bezeichnet.

Bei der Selbstaufmerksamkeit führt der Transformator mehrere Berechnungen gleichzeitig durch und vergleicht dabei verschiedene Eingabe-Tokens miteinander. Daraus wird für jedes Token bzw. Wort ein Ausgabeaufmerksamkeitswert berechnet. Je mehr Aufmerksamkeit ein Wort erhält, desto stärker wird es bei der Erstellung einer Ausgabe (oder Antwort) berücksichtigt.

Jetzt ist es an der Zeit, die numerischen Daten in eine textbasierte Antwort zu dekodieren. Bei diesem Prozess werden die codierten Eingabetokens in textbasierte Ausgabetokens umgewandelt, die die Antwort des LLM auf eine Eingabeaufforderung bilden.

Wo werden LLMs verwendet?

Es gibt eine Es gibt heute nur wenige große LLMs, darunter Claude, LaMDA, LLaMA, Cohere, GPT-3.5 und GPT-4. Viele dieser LLMs wurden von bekannten Technologiegiganten wie Google und Meta entwickelt, andere sind jedoch das Produkt von KI-fokussierten Unternehmen wie OpenAI und Anthropic. Die bekanntesten Beispiele für LLMs in Aktion sind KI-Chatbots wie Bard, ChatGPT, Claude und Bing Chat. Diese raffinierten Tools erfreuten sich Ende 2022 zunehmender Beliebtheit, nachdem OpenAI GPT-3.5 veröffentlicht hatte. Seitdem hat sich der Anwendungsbereich von LLMs enorm erweitert, KI-Chatbots erfreuen sich jedoch nach wie vor großer Beliebtheit. Denn KI-Chatbots können Nutzern eine Vielzahl von Diensten anbieten. Sie können diese Tools bitten, Fakten bereitzustellen, Texte zu übersetzen, Ideen zu generieren, Witze zu erzählen, Gedichte und Lieder zu schreiben und vieles mehr. Die Vielseitigkeit von KI-Chatbots macht sie in allen Lebensbereichen nützlich und Unternehmen arbeiten kontinuierlich daran, ihre KI-Chatbots für ein noch besseres Erlebnis zu verbessern. Aber bei KI-Chatbots hört es nicht auf. Einige sehr bekannte LLMs werden außerhalb von Chatbot-Umgebungen eingesetzt. Beispielsweise wird BERT von Google verwendet, um die Qualität von Suchmaschinenergebnissen zu verbessern, und es gab es etwa Jahre, bevor Chatbot-basierte LLMs populär wurden. Angesichts der Neuheit der LLM-Technologie gibt es auch viele potenzielle Einsatzmöglichkeiten, die in der Zukunft Anwendung finden könnten. LLMs können sich im Gesundheitswesen als nützlich erweisen, insbesondere bei Forschungsanalysen, Simulationen von Patientenszenarien, Entlassungszusammenfassungen und medizinischen Fragen. Allerdings haben die neuesten Versionen von LLMs immer noch mit sachlichen Ungenauigkeiten, Einschränkungen bei den Trainingsdaten und KI-Halluzinationen zu kämpfen, sodass sie möglicherweise noch nicht für den medizinischen Einsatz geeignet sind. LLMs stecken immer noch in den Kinderschuhen, da sie erst 1990 offiziell erfunden wurden 2017. Das Potenzial dieser Sprachverarbeitungsmethode ist jedoch wirklich erstaunlich, da LLM-basierte Tools bereits Funktionen bieten, die für Computer früher nicht möglich waren. In naher Zukunft werden LLMs möglicherweise noch weitere Fortschritte machen, da immer mehr Branchen die Technologie übernehmen.  Hannah Stryker/How-To Geek

Hannah Stryker/How-To Geek LLMs sind eine aufregende neue Technologie

Leave a Reply

You must be logged in to post a comment.