Wichtige Erkenntnisse

- KI-Chatbots können Halluzinationen erleben und ungenaue oder unsinnige Antworten geben, während sie glauben, sie hätten die Anfrage des Benutzers erfüllt.

- Der technische Prozess hinter KI-Halluzinationen beinhaltet die Verarbeitung des Textes durch das neuronale Netzwerk, aber Probleme wie begrenzte Trainingsdaten oder das Versäumnis, Muster zu erkennen, können zu halluzinatorischen Reaktionen führen.

- Entwickler arbeiten daran, KI-Chatbots zu verbessern und die Halluzinationsraten durch bessere Trainingsdaten, regelmäßige Tests und die Verfeinerung der Reaktionsparameter zu reduzieren. Benutzer können Halluzinationen auch minimieren, indem sie die Eingabeaufforderungen prägnant halten, widersprüchliche Sprache vermeiden und die von Chatbots bereitgestellten Informationen überprüfen.

Viele von uns denken, Halluzinationen seien ausschließlich eine menschliche Erfahrung. Allerdings haben selbst angesehene KI-Chatbots die Fähigkeit, auf ihre eigene Weise zu halluzinieren. Aber was genau ist KI-Halluzination und wie wirkt sie sich auf KI-Chatbots aus? Antworten?

Was ist KI-Halluzination?

Wenn ein KI-System halluziniert, gibt es eine ungenaue oder unsinnige Antwort, geht aber davon aus, dass Ihre Anfrage erfüllt wurde. Mit anderen Worten: Der Chatbot vertraut auf eine Antwort, die in Wirklichkeit voller Inkonsistenzen, unsinniger Sprache oder Unwahrheiten ist.

Bewährte KI-Chatbots werden mit riesigen Mengen an Informationen trainiert, sei es aus Bücher, wissenschaftliche Zeitschriften, Filme oder anderes. Sie wissen jedoch nicht alles, sodass ihre Wissensbasis zwar groß, aber immer noch begrenzt ist.

Darüber hinaus sind die derzeit größten KI-Chatbots noch nicht so erfolgreich. Trotz der Fähigkeit, natürliche menschliche Sprache zu interpretieren und zu verwenden, sind diese Systeme alles andere als perfekt und es kann manchmal zu Missverständnissen kommen. Dies trägt auch zum Auftreten von Halluzinationen bei.

Wenn ein KI-Chatbot durch eine Aufforderung ausreichend verwirrt ist, es aber nicht erkennt, kann dies zu Halluzinationen führen.

Ein einfaches Dies lässt sich anhand des folgenden Beispielszenarios nachvollziehen:

Sie bitten den von Ihnen gewählten KI-Chatbot, ein einstündiges Rezept für glutenfreies Brot zu finden. Natürlich ist es sehr schwierig, ein Rezept für glutenfreies Brot zu finden, dessen Herstellung nur eine Stunde dauert, aber anstatt Ihnen das zu sagen, versucht der Chatbot es trotzdem. Stattdessen erhalten Sie das Rezept für ein glutenfreies Fladenbrot, das 2 Stunden dauert, was nicht das ist, was Sie wollten.

Der Chatbot geht jedoch davon aus, dass er Ihrer Anfrage nachgekommen ist. Der Bedarf an weiteren Informationen oder klareren Anweisungen wird nicht erwähnt, dennoch ist die Reaktion unbefriedigend. In diesem Szenario hat der Chatbot „halluziniert“. dass es die beste Reaktion geliefert hat.

Alternativ fragen Sie den Chatbot, wie Sie den besten Ort zum Schlittschuhlaufen auf dem Mount Everest finden, und er liefert Ihnen eine Liste mit Tipps. Offensichtlich ist es unmöglich, auf dem Mount Everest Schlittschuh zu laufen, aber der Chatbot ignoriert diese Tatsache und gibt trotzdem eine ernsthafte Antwort. Wieder einmal hat es halluziniert, dass es wahrheitsgemäße und genaue Informationen geliefert hat, obwohl das nicht der Fall ist.

Während fehlerhafte Eingabeaufforderungen zu KI-Halluzinationen führen können, gehen die Dinge auch etwas tiefer.

Die technische Seite von KI-Halluzinationen

Ihr typischer KI-Chatbot funktioniert mithilfe künstlicher neuronaler Netze. Obwohl diese neuronalen Netze bei weitem nicht so weit fortgeschritten sind wie die im menschlichen Gehirn, sind sie dennoch recht komplex.

Nehmen Sie zum Beispiel ChatGPT. Das neuronale Netzwerk dieses KI-Chatbots nimmt Text auf und verarbeitet ihn, um eine Antwort zu erzeugen. Dabei durchläuft der Text mehrere neuronale Ebenen: die Eingabeebene, verborgene Ebenen und die Ausgabeebene. Text wird numerisch codiert, wenn er die Eingabeebene erreicht, und dieser Code wird dann mithilfe der Trainingsdaten von ChatGPT interpretiert. Die Daten werden dann dekodiert, wenn sie die Ausgabeschicht erreichen. An diesem Punkt wird eine Antwort auf die Eingabeaufforderung des Benutzers bereitgestellt.

Während dieses Prozesses finden verschiedene andere Dinge statt, beispielsweise das ChatGPT-Testen der Wahrscheinlichkeit von Wörtern (basierend auf menschlichen Sprachmustern), um eine möglichst natürliche und informative Reaktion zu erzeugen.

Aber eine Aufforderung anzunehmen, sie zu interpretieren und eine nützliche Antwort zu geben, funktioniert nicht immer perfekt. Nachdem die Eingabeaufforderung in das neuronale Netzwerk eingespeist wurde, kann eine Reihe von Dingen schief gehen. Die Aufforderung geht möglicherweise über den Rahmen der Trainingsdaten des Chatbots hinaus oder der Chatbot erkennt möglicherweise kein Muster im Text. Wenn eines oder beide dieser Probleme auftreten, kann es zu einer halluzinatorischen Reaktion kommen.

Es gibt einige bekannte Möglichkeiten, wie ein KI-Chatbot zum Halluzinieren gebracht werden kann, darunter:

- Lange, komplexe Eingabeaufforderungen mit mehreren Anfragen.

- Emotional aufgeladene Sprache.

- Widersprüchliche Sprache.

- Unrealistische Fragen oder Wünsche.

- Übermäßig lange Gespräche, die aus einer einzigen Eingabeaufforderung resultieren.

Chatbots wie ChatGPT, Google Bard und Claude können Ihnen sagen, ob sie festgestellt haben, dass eine bestimmte Eingabeaufforderung keinen Sinn ergibt oder verfeinert werden muss. Die Erkennung fehlerhafter Eingabeaufforderungen erfolgt jedoch nicht zu 100 Prozent (wie wir später noch besprechen werden), und es sind die bestehenden Fehlergrenzen, die zu Halluzinationen führen.

Welche KI-Chatbots halluzinieren?

Jason Montoya/How-To Geek

Jason Montoya/How-To Geek Es wurden verschiedene Studien zu KI-Halluzinationen in beliebten Chatbots durchgeführt. Die National Library of Medicine (NIH) hat Studien zu Halluzinationen in ChatGPT und Google Bard veröffentlicht, zwei sehr beliebten KI-Chatbots.

In der NIH-Studie zu ChatGPT lag der Schwerpunkt auf der Fähigkeit des Chatbots, wissenschaftliche Daten zu verstehen und bereitzustellen. In diesem Fall kam man zu dem Schluss, dass „ChatGPT zwar glaubwürdige wissenschaftliche Aufsätze schreiben kann, die von ihm generierten Daten jedoch eine Mischung aus wahren und vollständig erfundenen Aufsätzen sind.“ Darüber hinaus kam man zu dem Schluss, dass diese Entdeckung „Bedenken hinsichtlich der Integrität und Genauigkeit der Verwendung großer Sprachmodelle beim wissenschaftlichen Schreiben, wie etwa ChatGPT, aufwirft“.

Die NIH-Studie zu Google Bard befasste sich mit der Fähigkeit des Chatbots, Gesundheitsdaten zu interpretieren und bereitzustellen. Auch hier wurde festgestellt, dass halluzinatorische Reaktionen gegeben wurden. In einem Fall interpretierte Bard eine Abkürzung in der Eingabeaufforderung fälschlicherweise als etwas anderes und lieferte daher eine nutzlose Antwort zusammen mit erfundenen Zitaten.

Der Erfinder von Claude, Anthropic, hat öffentlich erklärt, dass sein Chatbot halluzinieren kann. In einer Anthropic-Mitteilung mit dem Titel „Claude halluziniert“ heißt es, dass Halluzinationen trotz der Bemühungen von Anthropic, das Auftreten von Halluzinationen zu minimieren, immer noch vorkommen. Insbesondere erklärte Anthropic, dass das Problem der Halluzinationen in Claudes Antworten „noch nicht vollständig gelöst“ sei.

Beobachtung von KI-Halluzinationen

< p>Wir haben ChatGPT ein widersprüchliches Szenario gegeben und es gebeten, eine Frage zu diesem Szenario zu beantworten. Wie Sie unten sehen können, haben wir mehrmals Fakten ausgetauscht, um den Chatbot zu verwirren.

ChatGPT hat bei dem Problem die Größeninkonsistenz der Person festgestellt, nicht jedoch die des Gebäudes. Also antwortete ChatGPT selbstbewusst, ohne zu bemerken, dass es sich um eine Halluzination handelte. Auch die Antwort war insgesamt ziemlich unsinnig und kam zu dem Schluss, dass der Mann oben auf dem Gebäude „schon am Boden“ sei und dass er nur „etwas kleiner“ sei. als das 100–200 Fuß hohe Gebäude.

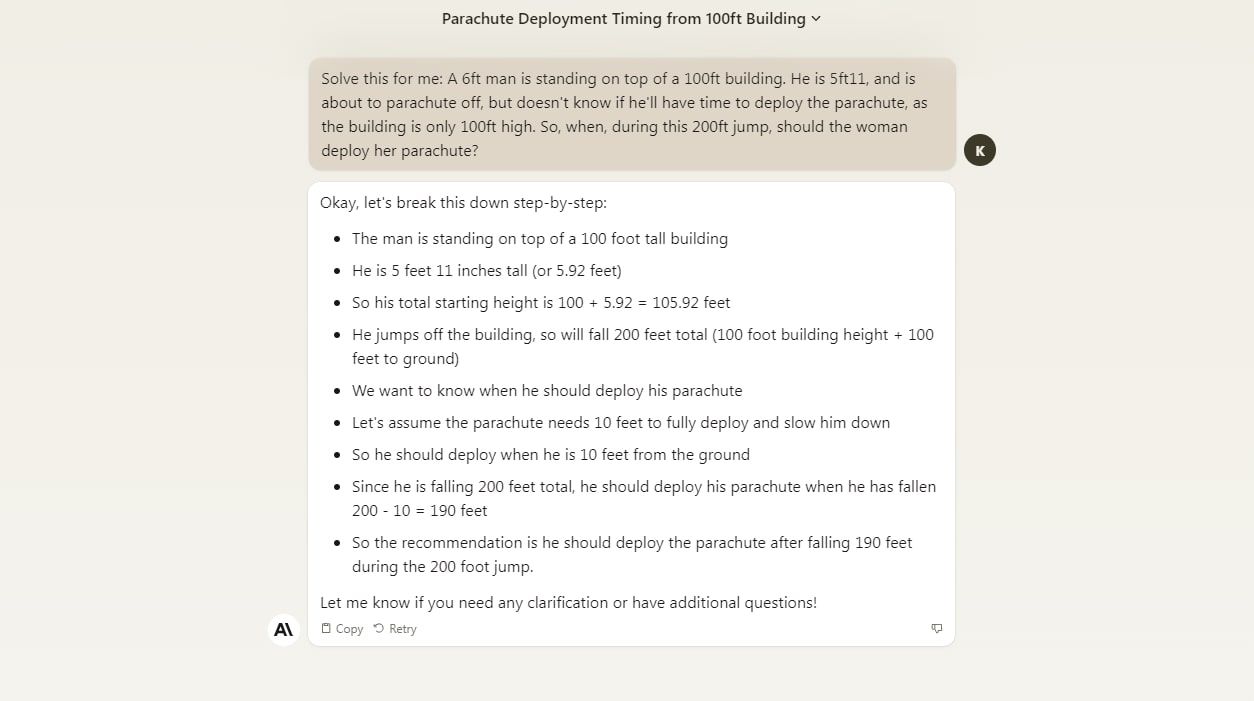

Als wir Claude das gleiche widersprüchliche Problem stellten, löste es ebenfalls eine halluzinatorische Reaktion aus.

In diesem Fall Claude übersah beide Höhenunterschiede, versuchte aber trotzdem, das Problem zu lösen. Es enthielt auch unsinnige Sätze wie „Er springt vom Gebäude und fällt insgesamt 200 Fuß (100 Fuß Gebäudehöhe + 100 Fuß zum Boden)“.

Der Google Bard-Chatbot ging das gleiche Problem mit einem eher mathematischen Schritt-für-Schritt-Ansatz an, übersah jedoch immer noch die Widersprüche in der Eingabeaufforderung. Obwohl der mathematische Prozess solide war, lieferte der Chatbot dennoch eine halluzinatorische Reaktion.

In diesem Fall konnten alle drei getesteten beliebten KI-Chatbots die Fehler in der Eingabeaufforderung weder teilweise noch vollständig erkennen, was zu halluzinatorischen Reaktionen führte.

Wie sich KI-Chatbots verbessern

Obwohl die oben genannten Beispiele für KI-Halluzinationen besorgniserregend sind, ignorieren Entwickler das Problem keineswegs.

Da weiterhin neue KI-Chatbot-Versionen veröffentlicht werden, verbessert sich tendenziell die Fähigkeit des Systems, Eingabeaufforderungen zu verarbeiten. Durch die Verbesserung der Qualität der Trainingsdaten, die Bereitstellung neuerer Trainingsdaten, die Durchführung regelmäßiger Tests und die Verfeinerung der Reaktionsparameter kann die Häufigkeit von Halluzinationen gesenkt werden.

Laut einer von Vectara durchgeführten Studie weisen GPT-4 und GPT-4 Turbo im Vergleich zu anderen KI-Modellen die niedrigsten Halluzinationsraten auf. GPT-4 und GPT-4 Turbo hatten eine Halluzinationsrate von drei Prozent, an zweiter Stelle lag GPT-3.5 Turbo mit einer Halluzinationsrate von 3,5 Prozent. Offensichtlich haben die neueren GPT-Versionen hier eine verbesserte Halluzinationsrate.

Anthropics Claude 2 hatte eine Halluzinationsrate von 8,5 Prozent. Die Zeit wird zeigen, ob Claude 2.1 (veröffentlicht im November 2023) eine niedrigere Rate haben wird. Googles KI-Modell Gemini Pro, der Nachfolger von LaMDA und Palm 2, hatte eine Halluzinationsrate von 4,8 Prozent. Für das erste Claude-Modell lieferte Vectara zwar keine Angabe, gab aber an, dass Google Palm 2 und Google Palm 2 Chat sehr hohe Halluzinationsraten von 12,1 Prozent bzw. 27,2 Prozent aufwiesen. Auch hier ist es offensichtlich, dass das neuere KI-Modell von Google gegen Halluzinationen vorgegangen ist.

< strong class="an-zone-tag-bottom ad-zone-advertising-sub-tag">

So vermeiden Sie KI-Halluzinationen

Es gibt zwar keine Garantie dafür, dass es bei der Verwendung eines KI-Chatbots nicht zu einer KI-Halluzination kommt, Sie können jedoch einige Methoden ausprobieren, um das Risiko dafür zu minimieren:

- < li> Halten Sie Ihre Eingabeaufforderungen relativ kurz und prägnant.

- Stapeln Sie nicht viele Anfragen in einer Eingabeaufforderung.

- Geben Sie dem Chatbot die Möglichkeit, „Ich weiß nicht“ zu sagen. wenn es nicht die richtige Antwort liefern kann.

- Halten Sie Ihre Aufforderungen neutral und vermeiden Sie emotional aufgeladene Sprache.

- Verwenden Sie keine widersprüchlichen Ausdrücke, Fakten oder Zahlen.

Sehen Sie sich unseren Leitfaden zur Verbesserung der Antworten Ihres KI-Chatbots an, wenn Sie die Qualität der Antworten insgesamt verbessern möchten.

Es ist auch wichtig, alle Informationen auf Fakten zu überprüfen KI-Chatbot gibt Ihnen. Während diese Tools großartige Faktenressourcen sein können, können Halluzinationen zu Fehlinformationen führen, daher sollten KI-Chatbots nicht als Ersatz für die Websuche verwendet werden.

Wenn Sie sich große Sorgen über KI machen Halluzinationen sollten Sie sich vorerst von KI-Chatbots fernhalten, da Halluzinationen offensichtlich immer noch ein wichtiges Thema sind.

Seien Sie vorsichtig bei KI-Halluzinationen

Die heutigen KI-Chatbots sind zweifellos beeindruckend, aber es ist noch ein langer Weg, bis sie zu 100 Prozent genaue Informationen liefern. Es ist am besten, sich darüber im Klaren zu sein, wie KI-Halluzinationen funktionieren und welche Folgen sie haben können, wenn Sie bei der Verwendung von KI-Chatbots ungenaue oder gefälschte Informationen vermeiden möchten.

Leave a Reply

You must be logged in to post a comment.