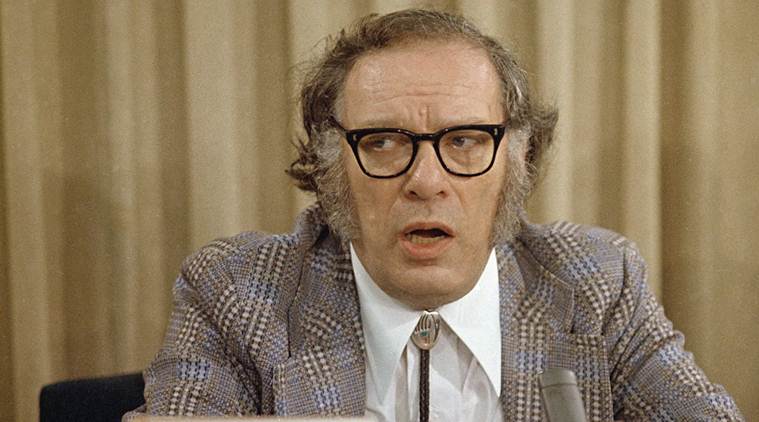

Isaac Asimov (Quelle: AP photo)

Isaac Asimov (Quelle: AP photo)

Vor vielen Monden, in 1942, wenn der intelligente Computer fing an, die Figur in der science fiction-Isaac Asimov legte drei Regeln für Roboter zu bauen: Sie sollten keinen Schaden zu tun, den Menschen entweder durch Handlung oder Unterlassung, muss immer gehorchen menschlichen Befehl; und in der Lage sein, um die Sicherung Ihrer eigenen Existenz so lange, wie dies nicht gegen die ersten beiden Regeln.

Rechenleistung wächst rasch und beginnt zu umhüllen viele Aspekte unseres Lebens, gab es eine wachsende Sorge, dass die Asimov-Regeln, vernünftig wie Sie sind, möglicherweise nicht ausreichend für das 21. Jahrhundert. Wissenschaftler wie Stephen Hawking und high-tech-Unternehmer wie Elon Musk haben die Alarmglocken zu super-intelligenten Computern “going rogue” und die dominierende, wenn nicht die Zerstörung der menschlichen Zivilisation.

Nicht jeder ist damit einverstanden, dass wir in der Nähe so einen katastrophalen moment. Aber angesichts der Geschwindigkeit der Fortschritte in der KI-Entwicklung, der wachsende Umfang für die Anwendung und die wachsende Intensität der aktuellen Forschung deutet darauf hin, dass es nicht sein kann, zu früh, zu überdenken, und überarbeiten Sie die Asimov-Befehle auf computing.

Genau das ist das, was eine große Gruppe von Forschern, Geschäftsleuten, Juristen und Ethiker haben letzten Monat, als Sie produziert eine Liste von 23 Empfehlungen für die Regelung der Zukunft der Künstlichen Intelligenz. Unterstützt von fast 900 KI-Forscher, die Prinzipien wäre viel zu idealistisch und vage.

Techno-Optimisten entlassen wird der code als “Maschinenstürmer-Manifest”. Einige Holen nits auf die Schwierigkeit zu definieren, die solche Dinge als ‘menschliche Werte’. Noch wichtiger die Juristen werden sagen, dass die Richtlinien nicht durchsetzbar sind. Für all Ihren Beschränkungen, die AI-code stellt eine deutliche Reflexion auf die außergewöhnlichen Herausforderungen der Robotik und des maschinellen Lernens.

Eine kritische Annahme ist, dass das Ziel der KI-Forschung sollte das Streben nach ‘vorteilhaft intelligence” und nicht mit “ungerichtete Intelligenz”. Es sollten nutzen und zu befähigen, so viele Menschen wie möglich’ und der Wohlstand generiert AI geteilt werden sollte breit’. Die Idee des gemeinsamen Nutzens, die in den Leitlinien wird ergänzt durch die these, dass Investitionen in die KI-Forschung sollte begleitet werden durch die Finanzierung der Forschung in Recht, Ethik und Sozialwissenschaften, Adresse der allgemeineren Fragen, die sich aus Fortschritten in der Datenverarbeitung. Es fordert auch mehr Kooperation, Vertrauen und Transparenz unter den KI-Forschern und Entwicklern.

Der neue code auch fordert der AI-Gemeinschaft zu vermeiden, schneiden Ecken auf Sicherheitsstandards, wie Sie im Wettbewerb mit einander, um zu ernten, die mehrere kommerzielle Vorteile aus der neuen Technologie. Die Grundsätze bestehen auf überprüfbare Sicherheit der KI-Systeme während Ihrer gesamten Lebensdauer. Die Frage der Transparenz in die Systeme ist ebenfalls als kritisch betrachtet. Der code besteht darauf, dass, wenn ein KI-system schädigt, ‘sollte es möglich sein festzustellen, warum.”

Ethik und Werte bilden eine wichtige dimension der vorgeschlagenen AI-code. Er betont, dass die Erbauer von AI-Systemen sind Stakeholder in die moralischen Implikationen Ihrer Verwendung und Missbrauch “und haben die Verantwortung, Sie zu konstruieren, um” kompatibel mit den idealen der Menschenwürde, der Menschenrechte, der Grundfreiheiten, der kulturellen Vielfalt”.

Das Thema der menschlichen Kontrolle über die Roboter entpuppt sich als die größte langfristige Herausforderung angesprochen, von der KI-code. Ein Verweis auf die Gefahren für die innere und internationale Sicherheit, Bedrohungen durch die neuen Technologien, der code erklärt, dass die KI sollte nicht erlaubt werden, zu unterlaufen, die menschliche Gesellschaft und fordert die Nationen zu vermeiden, ein “Wettrüsten” in der Entwicklung “tödliche autonome Waffen”.

Der code wird argumentiert, dass die KI könnte daneben eine “tief greifende Veränderung in der Geschichte des Lebens auf der Erde” und die katastrophale, existentielle Risiken, die Sie birgt, sollten verwaltet werden, mit der angemessenen Sorgfalt und Ressourcen”. Hinweis auf die Möglichkeit, Maschinen, die lernen, auf Ihre eigenen, Herstellung von Kopien und handeln autonom, der code erklärt, dass KI-Systeme entwickelt, um ‘sich selbst zu verbessern oder sich selbst repliziert in einer Weise, die dazu führen könnten, rapide steigende Qualität oder Quantität sein muss, unterliegen strengen Sicherheits-und Kontrollmaßnahmen.’

Nicht jeder ist zufrieden mit der Idee eines code of conduct für die KI-Entwicklung. Einige sind besorgt über die Möglichkeit von Regierungen treten in über-regulieren, eine Technologie, die bereit ist zum abheben. Sie würden Zustimmen, dass eine Beaufsichtigung erforderlich ist und dass AI selbst, vielleicht liefern die passenden Lösungen für effektive menschliche Aufsicht.

Auf der internationalen Ebene, die Großmächte, insbesondere die Vereinigten Staaten, China und Russland investieren im großen Stil in AI zu gewinnen, militärischen und strategischen Vorteile. Als eine expansive internationale Diskurs über AI entfaltet, Delhi ist untypisch stumm. Für fast sieben Jahrzehnte, Delhi war immer unter den ersten Verfechtern der globalen Debatten über die politischen, wirtschaftlichen, sozialen und ethischen Implikationen von technologischen Revolutionen. Auf die AI, obwohl, Delhi hat viel Nachholbedarf.

C. Raja Mohan ist Leiter der Carnegie-Indien, Delhi und consulting-editor für auswärtige Angelegenheiten für Den Indian Express© The Indian Express Online Media Pvt Ltd