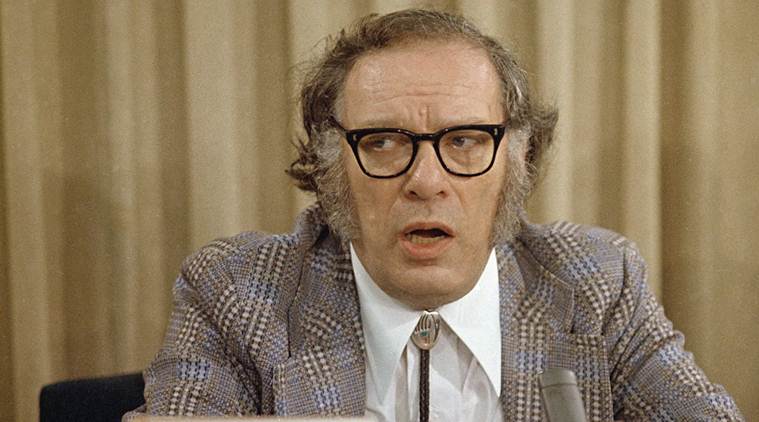

Isaac Asimov (Bron: AP photo)

Isaac Asimov (Bron: AP photo)

Vele manen geleden, in 1942, toen intelligente computers begon te achterhalen in science fiction, Isaac Asimov vastgelegd drie regels voor het bouwen van robots: ze mogen geen schade toebrengen aan de mens, hetzij door handelen of nalaten; moet altijd gehoorzamen menselijke opdracht; en in staat zijn om de beveiliging van hun eigen bestaan en voor zover dit niet in strijd is met de eerste twee regels.

Als rekenkracht snel groeit en begint te omhullen vele aspecten van ons leven, er is een groeiende bezorgdheid dat Asimov Regels, verstandig als ze zijn, niet toereikend is voor de 21e eeuw. Wetenschappers zoals Stephen Hawking en high-tech ondernemers als Elon Musk hebben geklonken-alarm klokken over de super intelligente computers ‘going rogue’ en domineert als het niet vernietigen van de menselijke beschaving.

Niet iedereen is het ermee eens dat we dicht bij een katastrofisch moment. Maar gezien het tempo van de vooruitgang, in AI, de ontwikkeling, het uitbreiden van de werkingssfeer voor de toepassing, en de groeiende intensiteit van het huidige onderzoek suggereert dat het niet te snel te herzien en herzien Asimov opdrachten met de computer.

Dat is precies wat een grote groep van onderzoekers, ondernemers, advocaten en ethici deed vorige maand als ze maakten een lijst van 23 aanbevelingen voor het reguleren van de toekomst van Kunstmatige Intelligentie. Goedgekeurd door bijna 900 AI-onderzoekers, van de beginselen zou verschijnen veel te idealistisch en te vaag.

Techno-optimisten ontslaat de code als een “manifest tegen moderne middelen’. Sommigen zullen kiezen neten op de moeilijkheid van het definiëren van zulke dingen als ‘menselijke waarden’. Nog belangrijker is de juristen zeggen dat de richtlijnen zijn niet afdwingbaar. Voor al haar beperkingen, de AI-code vormen een belangrijke reflectie op de buitengewone uitdagingen van robotica en machine learning.

Een kritische stelling is dat het doel van het AI-onderzoek moet worden in het nastreven van ‘de gunstige intelligence’ en niet de ‘niet-gestuurde intelligentie’. Het ‘voordeel en emancipatie van zoveel mogelijk mensen’ en de welvaart gegenereerd door de AI moet worden gedeeld’. Het idee van gedeelde voordelen in de richtlijnen wordt geëvenaard door de stelling dat de investeringen in het AI-onderzoek dient te worden vergezeld van de financiering voor onderzoek in het recht, ethiek en sociale studies die zal ingaan op de bredere vragen die voortkwamen uit de ontwikkelingen in de computer. Zij pleit ook voor meer samenwerking, vertrouwen en transparantie tussen de AI-onderzoekers en ontwikkelaars.

De nieuwe code spoort ook de AI van de gemeenschap om te voorkomen dat het snijden van hoeken op veiligheid, als ze met elkaar concurreren om te profiteren van de vele commerciële voordelen van de technologie in opkomst. De principes aandringen op controleerbare veiligheid van de AI-systemen, gedurende hun levensduur. De kwestie van de transparantie in de systemen wordt ook gezien als kritiek. De code wijst erop dat indien een AI-systeem schade veroorzaakt, ‘het moet mogelijk zijn om na te gaan waarom.’

Ethiek en waarden vormen een belangrijke dimensie van het voorgestelde AI-code. Het dringt erop aan dat de bouwers van de AI-systemen zijn ‘stakeholders in de morele implicaties van hun gebruik en misbruik’ en zijn verantwoordelijk voor het ontwerp, worden ze ‘verenigbaar met de idealen van de menselijke waardigheid, de rechten, vrijheden en culturele diversiteit’.

Het thema van de menselijke controle over de robots naar voren als de grootste lange-termijn uitdaging aangepakt door de AI-code. In een verwijzing naar de bedreigingen voor de interne en de internationale veiligheid bedreigd wordt door de nieuwe technologieën, de code verklaart dat AI niet mogen ondermijnen menselijke samenlevingen en naties dringt er bij om te voorkomen dat een ‘wapenwedloop’ in de ontwikkeling van ‘dodelijke autonome wapens’.

De code stelt dat AI kunnen markeren een ‘diepgaande verandering in de geschiedenis van het leven op aarde’ en de catastrofale en existentiële risico ‘ s die het met zich meebrengt moeten worden gehouden met ‘de verhouding zorg en middelen’. Wijzen op de mogelijkheid van machines leren op hun eigen, het produceren van kopieën van en handelen autonoom, de code verklaart dat AI systemen ontworpen om ‘zichzelf te verbeteren of zelf repliceren op een manier die kan leiden tot het snel verhogen van de kwaliteit of de hoeveelheid moet worden onderworpen aan strenge veiligheids-en controle-maatregelen.’

Niet iedereen is blij met het idee van een gedragscode voor AI ontwikkeling. Sommigen zijn bezorgd over de mogelijkheid van overheden stappen in de over-het regelen van een technologie die is klaar voor take-off. Ze zijn het erover eens dat een vorm van toezicht nodig is en dat de AI zelf zou kunnen bieden u de juiste oplossingen voor effectieve menselijk toezicht.

Op internationaal niveau is de grote mogendheden in het bijzonder de Verenigde Staten, China en Rusland investeren in een grote weg in AI te krijgen van militaire en strategische voordelen. Een grote internationale discours over AI zich ontvouwt, Delhi is ongewoon dempen. Bijna zeven decennia, Delhi was altijd een van de eerste krachten van het wereldwijde debat over de politieke, economische, sociale en ethische implicaties van technologische revoluties. AI, hoewel, Delhi heeft veel inhalen.

C. Raja Mohan is Directeur van de Carnegie India, Delhi en consulting editor op buitenlandse zaken voor De Indian Express© De Indian Express Online Media Pvt Ltd